ELTP devenu indispensable pour l’IA et l’analytics moderne

En data, on répète souvent les mêmes erreurs. Deux classiques :

- Tout faire en ETL monolithique (Extract → Transform → Load en un bloc fragile).

- Confondre lieu de traitement et lieu de diffusion (on transforme… mais on ne pense pas à livrer proprement).

Résultat : pipelines cassants, clusters saturés, CRM mal synchronisés, RAG bricolé à la va-vite.

La réponse n’est pas une énième mode. C’est un cadre simple : ELTP — Extract, Load, Transform, Publish.

Une architecture pensée pour :

- L’analytics à grande échelle

- La data engineering moderne

- Les cas d’usage IA (RAG, vector stores, automatisation métier)

ETL → ELT → ELTP : évolution logique

1️⃣ ETL : fragile par conception

Dans l’approche historique ETL :

Source → Transformation → Chargement

Problèmes classiques :

🚀 Devenez un expert en Data Marketing avec nos formations !

Maîtrisez les outils essentiels pour analyser, automatiser et visualiser vos données comme un pro. De BigQuery SQL à Google Apps Script, de n8n à Airtable, en passant par Google Sheets et Looker Studio, nos formations couvrent tous les niveaux pour vous permettre d’optimiser vos flux de données, structurer vos bases SQL, automatiser vos tâches et créer des dashboards percutants. Que vous soyez débutant ou avancé, chaque formation est conçue pour une mise en pratique immédiate et un impact direct sur vos projets. Ne subissez plus vos données, prenez le contrôle dès aujourd’hui ! 📊🔥

- Si la logique métier casse → les données ne sont pas chargées.

- Les agrégations lourdes explosent la mémoire.

- Plus le volume grossit, plus le pipeline devient instable.

On mélange réplication technique et logique business. Mauvaise idée.

2️⃣ ELT : séparation salutaire

L’approche moderne ELT :

Source → Load (brut) → Transform (dans l'entrepôt)

On sépare :

- EL (Extract + Load) = réplication fiable

- T (Transform) = logique métier versionnée

On charge d’abord les données brutes dans un entrepôt (ex : BigQuery, Snowflake, Redshift), puis on applique les transformations via SQL, dbt ou Python.

C’est plus robuste. Mais incomplet.

3️⃣ ELTP : la brique manquante

ELTP ajoute une étape essentielle :

Extract → Load → Transform → Publish

La différence est stratégique :

ELT pense stockage.

ELTP pense diffusion.

Et dans un monde IA + SaaS + APIs, la diffusion est aussi critique que la transformation.

Le cœur du sujet : la phase “Publish”

La phase Publish consiste à envoyer les données transformées vers :

- CRM (Salesforce, HubSpot)

- Outils marketing (Marketo, Brevo)

- ERP

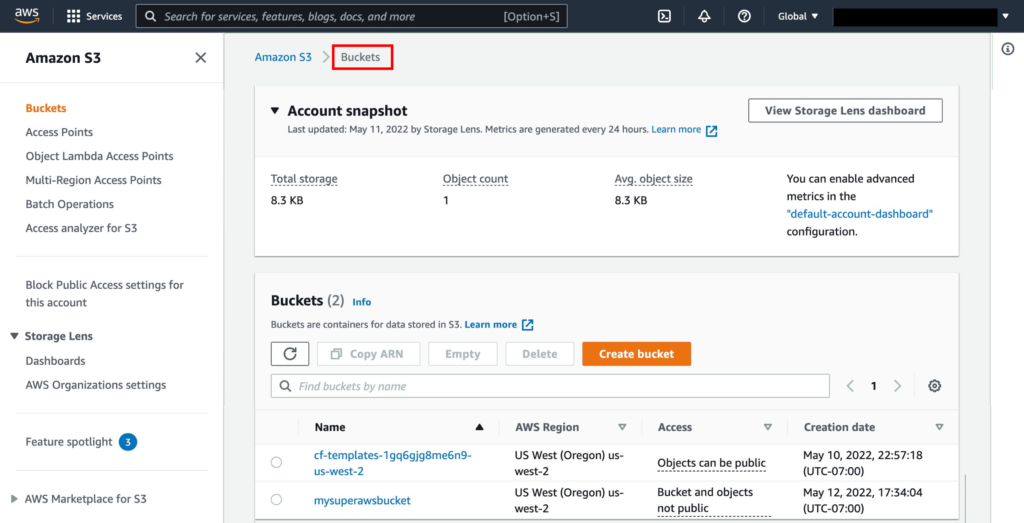

- Fichiers S3 / SFTP

- Dashboards BI

- Bases externes

- Vector stores (RAG)

En clair : c’est l’équivalent d’un Reverse ETL, mais plus large.

Tous les Reverse ETL sont des Publish.

Mais tous les Publish ne sont pas du Reverse ETL.

Cas d’usage concrets

1️⃣ Publication de fichiers vers partenaires

4

Exemple :

- Extraction données clients

- Transformation en format CSV normé

- Publication sur :

- S3 pour une agence marketing

- SFTP pour un organisme réglementaire

Contraintes :

- Format imposé

- Fréquence imposée

- Contrôle d’intégrité

Sans étape Publish formalisée, ces flux deviennent artisanaux.

2️⃣ Protéger le Data Warehouse

Problème vécu dans de nombreuses entreprises :

- Cluster optimisé pour transformations lourdes

- Utilisateurs exécutent des requêtes ad-hoc mal optimisées

- Saturation CPU

- Coûts cloud qui flambent

Solution ELTP :

- Transformer dans l’entrepôt

- Publier vers :

- S3 datasets

- Tableau

- Base dédiée aux requêtes concurrentes

On découple :

- Zone industrielle

- Zone analytique

- Zone consommation

C’est de l’architecture sérieuse.

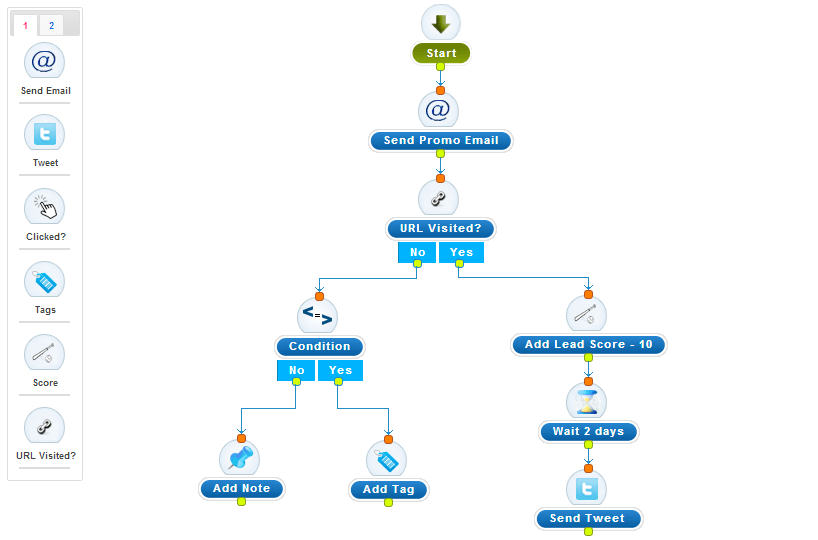

3️⃣ Reverse ETL vers CRM

Cas typique :

- Score client calculé dans l’entrepôt

- Segmentation marketing enrichie

- Score churn prédictif

On publie vers :

- Salesforce

- HubSpot

- ActiveCampaign

Objectif :

- Les équipes métier travaillent avec la donnée enrichie.

- Pas avec des exports Excel bricolés.

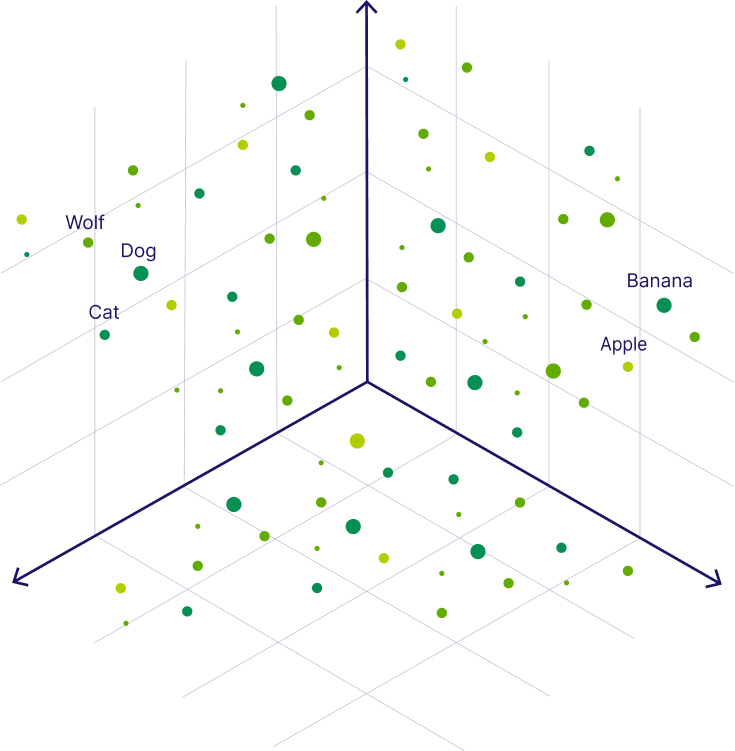

4️⃣ Publish vers vector store (RAG)

Pour un chatbot IA interne :

Flux ELTP :

- Extract : PDF, Notion, Google Docs

- Load : stockage brut en data lake

- Transform :

- découpage en chunks

- génération embeddings

- Publish vers vector store :

- Pinecone

- Weaviate

- Milvus

Le chatbot interroge ensuite l’index via RAG.

Pourquoi ELTP change tout pour l’IA

Beaucoup de tutoriels RAG font :

Extract → Transform → Load direct dans le vector store

Rapide.

Pratique.

Dangereux en production.

Pourquoi ?

- Impossible de rejouer les transformations proprement

- Impossible de tester plusieurs modèles d’embedding

- Impossible de faire des A/B sur chunking

- Pas de versionning clair

Avec ELTP :

- Les données brutes sont conservées.

- On peut recalculer les embeddings.

- On peut comparer OpenAI vs autre modèle.

- On peut itérer sans réextraire les documents.

C’est ce qui sépare un POC LinkedIn d’un système production.

Architecture type ELTP (vue synthétique)

| Étape | Objectif | Infrastructure typique |

|---|---|---|

| Extract | Récupérer la donnée | Connecteurs API, fichiers, scraping |

| Load | Stockage durable brut | Data warehouse / data lake |

| Transform | Logique métier, nettoyage | SQL, dbt, Python |

| Publish | Diffusion vers systèmes | APIs SaaS, S3, CRM, vector store |

Pourquoi ajouter du stockage réduit le coût total

Ça semble contre-intuitif.

Ajouter une couche de stockage devrait coûter plus cher.

En réalité :

- Moins de recalcul

- Moins de réextraction

- Moins de pannes globales

- Moins d’effet domino

La décorrélation des étapes réduit le TCO.

En architecture, le couplage coûte plus cher que le stockage.

Reverse ETL n’est pas suffisant

Le terme Reverse ETL est utile, mais restrictif.

Publish peut viser :

- SFTP

- S3

- SharePoint

- API partenaire

- Base externe

- Index IA

ELTP est un modèle architectural.

Reverse ETL est un cas particulier.

ELTP et outils open source

Airbyte est un exemple d’outil permettant :

- Extract + Load

- Publish

- Connecteurs personnalisables

- Support vector stores

Il permet d’industrialiser ELTP via :

- UI low-code

- API

- Terraform

- Connecteurs custom

Mais le concept ELTP est indépendant de l’outil.

Erreurs fréquentes à éviter

❌ 1. ETL monolithique

Tout dans un seul script Python.

❌ 2. Vector store comme stockage principal

Un index n’est pas un entrepôt.

❌ 3. Pas de versionning des transformations

Impossible de reproduire les résultats.

❌ 4. Requêtes directes sur cluster de prod

Une requête mal optimisée peut coûter des milliers d’euros.

Quand utiliser ETL simple ?

Pour un POC.

Pour un hackathon.

Pour un prototype court.

Mais si le projet survit plus de 3 mois :

Passe en ELTP.