Firebase A/B Testing arrive enfin sur le Web : ce que ça change vraiment pour vos expérimentations produit

Le sujet paraît anodin. Il ne l’est pas.

Jusqu’ici, Firebase A/B Testing était surtout perçu comme un outil mobile. Depuis le 4 mars 2026, Firebase permet aussi de créer des A/B tests pour des applications web, en s’appuyant sur Firebase Remote Config pour servir les variantes et Google Analytics pour mesurer les résultats. En clair : vous pouvez désormais tester un parcours, un wording, une onboarding, une mise en page ou un feature flag côté web sans reconstruire toute une mécanique maison d’expérimentation. (The Firebase Blog)

Ce n’est pas juste une “nouvelle option dans la console”. C’est un changement plus profond : Firebase devient enfin cohérent pour les équipes qui veulent piloter un produit web avec la même logique que sur mobile, c’est-à-dire configuration distante + mesure + décision statistique + rollout. Et pour beaucoup d’équipes front, produit ou growth, c’est potentiellement la fin du faux A/B test bricolé à base de “on met une variante dans le code et on regarde GA4 dans une semaine”.

- Firebase A/B Testing arrive enfin sur le Web : ce que ça change vraiment pour vos expérimentations produit

- Ce que Firebase apporte concrètement

- Pourquoi cette nouveauté compte vraiment pour le Web

- Le vrai cœur du système : Remote Config devient votre couche d’expérimentation

- Le code : simple en apparence, exigeant en réalité

- Première limite sérieuse : pas d’activation event sur le Web

- Deuxième limite : l’identité utilisateur côté Web n’est pas aussi stable qu’on pourrait l’espérer

- Ce que ça permet de tester intelligemment

- Ce qu’il ne faut pas attendre de Firebase A/B Testing pour le Web

- La stat : Firebase vous aide, mais il ne pense pas à votre place

- Le rythme d’un test : plus lent que ce que veulent les équipes pressées

- BigQuery : l’endroit où les équipes sérieuses iront vérifier

- Les conditions pour que ça marche vraiment

- Les équipes qui vont vraiment en profiter

- Mon verdict

Ce que Firebase apporte concrètement

Petite intro (qui date un peu) sur Firebase Analytics.

Passons aux choses sérieuses !

Le mécanisme repose sur trois briques.

Première brique : Remote Config.

C’est lui qui distribue les variantes. Vous définissez un ou plusieurs paramètres — par exemple hero_title_variant, pricing_layout ou onboarding_flow — puis Firebase affecte les utilisateurs éligibles à une variante ou à la baseline. Les expériences Remote Config sont désormais officiellement supportées sur Android, iOS et Web.

Deuxième brique : Google Analytics.

C’est Analytics qui alimente la mesure : conversion, engagement, rétention, revenu et autres événements remontés par votre instrumentation. Firebase précise d’ailleurs que l’intégration Analytics sert directement aux A/B tests, aux rollouts et à la personnalisation.

🚀 Maîtrisez les outils Web Analytics et optimisez votre croissance dès aujourd’hui

Transformez vos données en leviers de performance ! Nos formations en Web Analytics vous permettent de mesurer, analyser et perfectionner l’expérience utilisateur de votre site avec précision. De Google Tag Manager à Piwik Pro, en passant par Matomo Analytics et Google Analytics 4, nous vous guidons à chaque niveau pour une maîtrise complète des outils essentiels. Apprenez à structurer vos données, affinez votre stratégie digitale et prenez des décisions basées sur des insights fiables. Ne laissez plus vos performances au hasard : formez-vous et passez à l’action dès maintenant !

Troisième brique : le moteur statistique de Firebase.

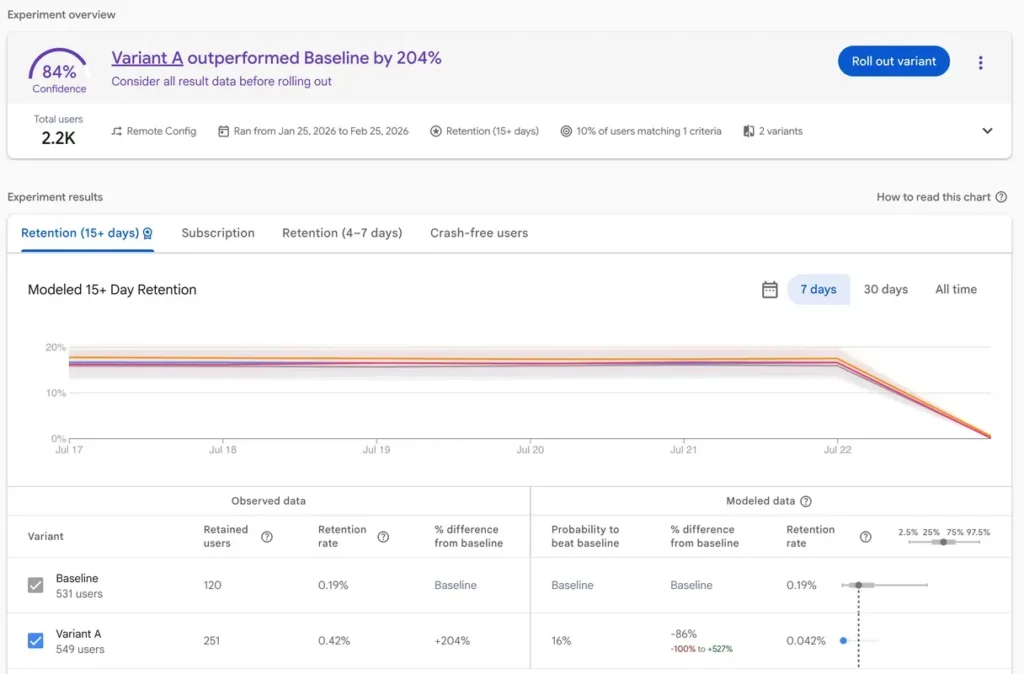

Firebase A/B Testing utilise aujourd’hui une approche fréquentiste, avec calcul de p-value, seuil de significativité à 0,05, intervalle de confiance à 95 %, et choix d’un leader quand une variante surperforme la baseline de manière statistiquement significative.

Dit autrement : Firebase ne se contente pas d’afficher des taux de clic. Il essaie de répondre à la vraie question : “est-ce qu’on observe un effet réel, ou juste du bruit statistique ?”

Pourquoi cette nouveauté compte vraiment pour le Web

Sur le Web, beaucoup d’équipes pensent faire de l’expérimentation alors qu’elles font surtout de la comparaison approximative.

Le problème est connu :

- la variante est câblée à la main,

- l’assignation n’est pas toujours stable,

- les événements ne sont pas propres,

- les populations ne sont pas comparables,

- le résultat est lu trop tôt,

- et tout le monde conclut quand même que “la version B marche mieux”.

Avec Firebase, le schéma devient plus sérieux :

- la variation est servie par un système conçu pour ça ;

- la distribution entre baseline et variantes est gérée dans la console ;

- l’analyse s’appuie sur les événements Analytics ;

- la variante gagnante peut ensuite être rolloutée à tout le trafic ciblé.

C’est particulièrement intéressant pour les équipes qui travaillent déjà avec :

- une app web React, Next, Vue ou autre SPA,

- Firebase côté front,

- GA4 / Google Analytics déjà instrumenté,

- et une logique produit itérative où les changements UI et UX sont fréquents.

Là où beaucoup d’outils d’A/B testing web sont pensés marketing ou CRO pur, Firebase est plus naturel pour un usage feature-oriented : tester un onboarding, un écran, une hiérarchie de contenu, un wording d’activation, un ordre d’étapes, un comportement UI piloté par un paramètre. C’est moins “éditeur visuel de landing page”, plus “pilotage de produit par configuration”. Cette lecture est une inférence logique à partir du fait que Firebase A/B Testing for Web repose sur Remote Config et sur des paramètres applicatifs, pas sur un éditeur WYSIWYG DOM-first.

Le vrai cœur du système : Remote Config devient votre couche d’expérimentation

C’est probablement le point le plus important.

Firebase ne vous donne pas un outil magique qui modifie votre site tout seul. Il vous donne une couche de décision. Ensuite, c’est votre application qui réagit à cette décision.

Exemple simple :

- paramètre

cta_copy - baseline : “Créer un compte”

- variante A : “Commencer gratuitement”

- variante B : “Tester sans engagement”

Ou version plus sérieuse :

- paramètre

onboarding_flow - baseline : parcours en 4 étapes

- variante A : parcours en 2 étapes

- variante B : onboarding progressif après première action

Ou encore :

- paramètre

pricing_layout - baseline : grille 3 colonnes

- variante A : plan recommandé mis en avant

- variante B : version annuelle priorisée

Dans tous ces cas, la logique de variation reste propre, explicite et versionnable. On ne bidouille pas le DOM après chargement comme dans certains vieux setups d’optimisation. On pilote le comportement natif de l’application. C’est plus robuste, plus maintenable, et généralement moins destructeur pour les performances et pour la qualité du tracking. Cette conclusion relève de l’architecture même de Remote Config, documentée comme système de paramètres consommés par l’application.

Le code : simple en apparence, exigeant en réalité

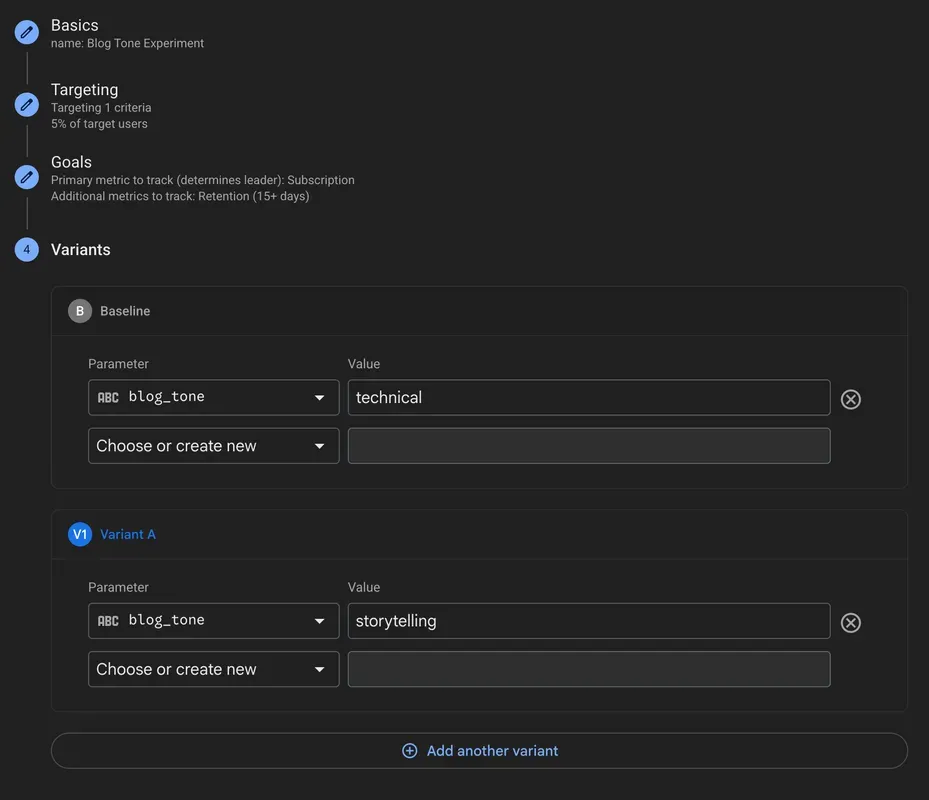

L’annonce Firebase donne un exemple très direct : on récupère un paramètre Remote Config, on lit sa valeur, puis on charge le contenu ou le composant correspondant. Dans l’exemple du billet, un paramètre blog_tone ou onboarding_flow pilote la variation affichée à l’utilisateur.

Sur le principe, cela ressemble à quelque chose comme ça :

import { getAnalytics } from "firebase/analytics";

import { getRemoteConfig, fetchAndActivate, getValue } from "firebase/remote-config";

const analytics = getAnalytics(app);

const remoteConfig = getRemoteConfig(app);

await fetchAndActivate(remoteConfig);

const onboardingFlow = getValue(remoteConfig, "onboarding_flow").asString();

if (onboardingFlow === "new_design") {

renderNewOnboarding();

} else {

renderStandardOnboarding();

}Le code est simple. La difficulté n’est pas là.

La difficulté réelle est ailleurs :

- quand déclencher

fetchAndActivate, - quelle valeur par défaut afficher,

- comment éviter un flash visuel entre baseline et variante,

- comment garantir que l’événement de conversion se déclenche proprement,

- comment s’assurer que le paramètre est bien appliqué avant l’interaction mesurée.

Et c’est là que beaucoup de tests “propres sur le papier” deviennent mauvais en production.

Firebase précise d’ailleurs deux choses importantes :

- Les mises à jour Remote Config en temps réel ne sont pas supportées pour les valeurs d’A/B test. Il faut utiliser une stratégie de type fetch and activate.

- Pour le Web, les activation events ne sont pas supportés dans les implémentations A/B testing web.

Ces deux détails ont des implications très concrètes.

Première limite sérieuse : pas d’activation event sur le Web

Sur mobile, un activation event permet de dire : “je ne mesure l’expérience que pour les utilisateurs qui ont réellement atteint tel moment du parcours”. C’est une sécurité méthodologique utile.

Sur le Web, Firebase précise noir sur blanc que les activation events ne sont pas pris en charge pour les implémentations web.

Conséquence : vous devez être encore plus rigoureux sur votre instrumentation.

Sinon, vous risquez de :

- compter des utilisateurs exposés mais jamais réellement confrontés à la variante,

- mesurer trop tôt,

- ou mélanger exposition technique et exposition métier.

En pratique, cela pousse à concevoir les tests web autour d’événements Analytics très propres :

sign_uppurchasegenerate_leadbegin_checkouttutorial_completed- ou un événement custom bien défini comme

onboarding_finished

Autrement dit : Firebase vous fournit le cadre, mais la discipline de mesure reste votre problème.

Deuxième limite : l’identité utilisateur côté Web n’est pas aussi stable qu’on pourrait l’espérer

Firebase explique que, pour le Web, l’assignation à une variante repose sur un Firebase Installation ID (FID) stocké dans le navigateur, dans IndexedDB. Ce FID sert à identifier l’instance et à maintenir l’affectation de la variante au fil des sessions.

Très bien. Sauf que Firebase précise aussi qu’un utilisateur peut être traité comme un nouvel utilisateur s’il :

- utilise un autre navigateur,

- passe en navigation privée,

- ou vide l’IndexedDB du navigateur.

Ça change quoi ?

Ça veut dire qu’en environnement web :

- l’unicité utilisateur est plus fragile ;

- la persistance d’exposition est moins forte qu’avec un identifiant applicatif stable ;

- un même humain peut théoriquement tomber dans plusieurs variantes selon son contexte de navigation.

Pour un petit test sur une landing page, ce n’est pas dramatique.

Pour des expériences à fort enjeu sur un tunnel complexe B2B ou e-commerce, il faut le savoir. Sinon, vous allez croire que votre randomisation est “par utilisateur”, alors qu’elle est en pratique plus proche d’une randomisation par instance navigateur.

Ce n’est pas une critique de Firebase. C’est la réalité du Web moderne.

Ce que ça permet de tester intelligemment

Firebase met en avant plusieurs cas d’usage :

- variations de contenu,

- optimisation de parcours utilisateur,

- adoption de fonctionnalités,

- pilotage de métriques business comme la conversion, le revenu, la rétention ou l’engagement.

Sur le terrain, les meilleurs cas d’usage web me semblent être les suivants.

1. Tester une logique produit, pas juste un habillage

Exemples :

- onboarding en 2 étapes vs 4 étapes ;

- demande d’email avant ou après la démonstration ;

- activation d’un assistant IA dès l’entrée vs après première action ;

- bloc de réassurance avant ou après formulaire.

Là, Firebase est pertinent parce que la variation vient d’un paramètre applicatif, pas d’un bricolage visuel.

2. Tester des messages liés à l’intention

Exemples :

- CTA orienté résultat vs CTA orienté essai ;

- wording technique vs wording métier ;

- bénéfice principal “gain de temps” vs “réduction des erreurs”.

Le billet Firebase utilise précisément un exemple de tonalité de contenu “technical” versus “storytelling” pour mesurer l’impact sur l’abonnement et la rétention.

3. Tester des priorisations de parcours

Exemples :

- version annuelle mise en avant ;

- parcours self-service vs prise de rendez-vous ;

- formulaire long vs qualification progressive.

4. Tester l’introduction d’une nouvelle fonctionnalité

Exemples :

- affichage d’un nouveau module IA ;

- emplacement d’une recommandation ;

- mode d’entrée dans une fonctionnalité premium.

Bref, tout ce qui relève de la logique d’expérience, pas seulement du maquillage.

Ce qu’il ne faut pas attendre de Firebase A/B Testing pour le Web

Il faut être clair : ce n’est pas le remplaçant universel de tous les outils d’expérimentation web.

Firebase A/B Testing pour le Web n’est pas, à ce stade :

- un éditeur visuel de variantes pour non-techniciens ;

- un outil de test multivarié ultra-avancé pour équipes CRO massives ;

- un système natif d’analyse comportementale approfondie type session replay ;

- ni un framework de causal inference sophistiqué.

C’est une couche d’expérimentation produit intégrée à l’écosystème Firebase.

Donc si votre besoin est :

- “changer visuellement un bouton sur une page marketing sans release”,

- “laisser l’équipe marketing modifier le DOM en drag-and-drop”,

- “croiser heatmaps, rage clicks et session recordings”,

alors Firebase ne couvre pas tout le besoin à lui seul.

En revanche, si votre besoin est :

- “tester proprement une variante de feature dans une app web”,

- “servir les variantes via paramètres”,

- “mesurer avec Analytics”,

- “rollout la gagnante sans refaire la plomberie”,

alors là, le fit est très bon. Cette évaluation est déduite de la nature des composants officiellement mobilisés : Remote Config, Analytics, console A/B Testing, et rollout via template Remote Config.

La stat : Firebase vous aide, mais il ne pense pas à votre place

C’est souvent là que les équipes se racontent des histoires.

Firebase fournit :

- la comparaison baseline / variantes,

- les données observées,

- les inférences statistiques,

- les p-values,

- les intervalles de confiance,

- et la désignation éventuelle d’un leader.

Très bien. Mais une bonne décision d’expérimentation ne repose jamais sur un seul chiffre.

Firebase lui-même rappelle qu’il faut regarder aussi les métriques secondaires avant de déployer une variante gagnante. Une variante peut gagner sur la métrique primaire et détériorer une autre métrique importante.

Exemple classique :

- variante A améliore le taux d’inscription ;

- mais diminue la qualité des leads ;

- ou augmente les désinscriptions ;

- ou dégrade la rétention à J7 ;

- ou fait monter le support.

La plateforme vous dira peut-être “leader”.

Votre métier doit encore répondre à la vraie question : leader pour quoi, et à quel prix ?

Le rythme d’un test : plus lent que ce que veulent les équipes pressées

Firebase indique plusieurs repères utiles :

- les résultats sont rafraîchis une fois par jour ;

- pour une expérience Remote Config typique, deux semaines de runtime minimum sont recommandées ;

- une expérience est traitée pendant 90 jours maximum, puis arrêtée automatiquement. (Firebase)

Donc non, vous ne lancez pas un test le lundi pour “prendre une décision fiable mercredi matin” sauf cas de trafic énorme et effet massif.

Il faut accepter trois choses :

- un test a besoin de volume ;

- un test a besoin de temps ;

- un test a besoin d’un signal métier clair.

Sans ça, l’A/B test n’est pas une démarche scientifique. C’est juste une décoration data.

BigQuery : l’endroit où les équipes sérieuses iront vérifier

C’est probablement l’aspect le plus intéressant pour les profils data.

Firebase précise que les données d’expérimentation peuvent être analysées dans BigQuery, car les informations d’expérience et de variante sont stockées dans les événements Google Analytics via des user properties du type firebase_exp_%. La console peut même générer une requête de départ pour interroger les événements liés à une expérience donnée.

C’est important pour trois raisons.

1. Vérifier les résultats

Vous n’êtes pas obligé de faire confiance aveuglément à la console Firebase. Vous pouvez requêter les événements, recomposer les cohortes, recalculer des taux, contrôler des segments.

2. Aller au-delà de la métrique principale

Vous pouvez analyser :

- la qualité des leads,

- la marge,

- la durée avant conversion,

- la profondeur d’usage,

- la rétention par segment,

- le comportement des nouveaux vs anciens utilisateurs.

3. Brancher l’expérimentation au vrai pilotage business

Là, on sort du gadget.

Quand vous reliez Firebase A/B Testing à BigQuery, vous pouvez comparer les variantes non seulement sur des événements Analytics standards, mais sur vos métriques métier consolidées.

Et là, d’un coup, l’expérimentation cesse d’être une affaire de “bouton bleu vs bouton vert”. Elle devient un levier de décision produit, revenue et activation.

Les conditions pour que ça marche vraiment

Firebase simplifie l’infrastructure. Il ne simplifie pas la rigueur.

Pour qu’un A/B test web soit utile, il faut au minimum :

| Élément | Ce qu’il faut vraiment |

|---|---|

| Hypothèse | Une vraie question métier, pas une intuition décorative |

| Paramétrage | Une variation pilotée proprement par Remote Config |

| Tracking | Des événements Analytics fiables, stables, documentés |

| Population | Une cible suffisamment large et cohérente |

| Lecture des résultats | Mêmes définitions, même fenêtre, mêmes KPI |

| Décision | Regarder aussi les métriques secondaires et le contexte métier |

| Vérification | Idéalement un contrôle BigQuery pour les tests importants |

Sans ça, même avec un bon outil, vous produirez de mauvaises conclusions.

Les équipes qui vont vraiment en profiter

Cette nouveauté sera surtout utile à quatre profils.

Les équipes produit

Elles vont pouvoir tester plus vite des variantes de flux, d’onboarding, de hiérarchie d’interface ou d’introduction de fonctionnalités.

Les équipes growth

Elles pourront tester des messages, parcours, ordres d’étapes et points de friction sur des apps web sans dépendre d’une stack d’expérimentation séparée.

Les équipes front

Elles gagnent un mécanisme intégré, cohérent avec une logique de feature flags et de paramètres applicatifs.

Les équipes data

Elles récupèrent enfin une chaîne plus propre entre assignation, mesure Analytics et analyse BigQuery. (Firebase)

Mon verdict

Cette sortie est une bonne nouvelle. Pas parce que Firebase “invente l’A/B testing web”. Il existe depuis longtemps ailleurs. Mais parce que Firebase rend enfin l’expérimentation web native, cohérente et industrialisable dans son propre écosystème.

Le gain réel n’est pas seulement technique. Il est méthodologique.

Firebase pousse une approche où :

- la variante est un paramètre,

- le comportement applicatif est explicite,

- la mesure est branchée sur Analytics,

- la lecture est statistique,

- et le déploiement final passe par rollout.

C’est propre. C’est moderne. Et surtout, c’est beaucoup plus sérieux que la majorité des pseudo-tests que je vois encore sur le Web.

La réserve, elle est claire :

- l’identité web reste moins stable ;

- les activation events ne sont pas disponibles sur le Web ;

- les résultats ne tombent pas en temps réel ;

- et l’outil n’efface ni les problèmes de tracking, ni les erreurs de design expérimental.

En un mot : bonne nouveauté, vrai potentiel, mais seulement pour les équipes qui savent déjà que tester n’est pas juste comparer deux écrans.