Préférez des serveurs MCP maintenus, Docker‑ready et compatibles HTTP streamable (ex. Qdrant, PostgreSQL via crystaldba, implémentations officielles GitHub/n8n) pour fiabilité et sécurité (cf. documentation n8n, Qdrant, Docker). Lisez la suite pour une feuille de route pratique et des workflows prêts à produire.

Quels critères pour sélectionner des serveurs MCP fiables

Privilégiez des implémentations officielles ou activement maintenues, avec image Docker officielle, capacité d’orchestration (Kubernetes/docker‑compose) et compatibilité HTTP streamable — c’est non négociable pour des agents IA productifs.

Choisissez des serveurs MCP (model control plane) qui combinent maintenance active, packaging Docker et support du streaming HTTP pour réduire la latence et faciliter l’intégration avec des agents. Voici les critères techniques et opérationnels à valider.

Critères techniques et opérationnels

- Projet mature : vérifier commits récents (6 derniers mois), taux de résolution des issues, et un nombre significatif d’étoiles/contributeurs — indicateurs concrets de pérennité.

- Images Docker officielles : présence d’images signées et mises à jour sur Docker Hub/ghcr; privilégier image officielle pour la traçabilité et les correctifs.

- Orchestration : support natif ou documents pour Kubernetes (Helm, manifests) et docker‑compose ; auto‑scaling et probes (liveness/readiness) indispensables.

- Authentification & TLS : support OAuth/OpenID, mTLS ou API keys, et terminologie TLS sans bricolage.

- Scalabilité et limites : tests de montée en charge, limites CPU/RAM par instance ; planifiez le sharding pour les vecteurs et la RAG (embedding cache coûteux en RAM).

- Latence des transports : HTTP streamable (chunked/SSE/WebSocket) pour renvoyer des tokens en temps réel ; mesurez RTT et throughput pour vos contraintes UX.

Risques de sécurité et recommandations

Intégrez l’IA Générative (GenAI) dans votre activité

Nos formations IA Générative (GenAI) et prompt engineering sont conçues pour les équipes qui veulent apprendre à exploiter les IA comme un pro. Vous y apprenez à structurer des prompts efficaces, à exploiter les meilleurs outils (assistants IA type ChatGPT, générateurs d’images, audio et vidéo) et à les appliquer à vos vrais cas métiers : analyser vos données (GA4, BigQuery, CRM…), produire des contenus clairs et crédibles, prototyper plus vite et automatiser les tâches répétitives. Des ateliers 100 % pratiques, pensés pour les entreprises, pour gagner du temps, sécuriser vos usages et livrer des analyses et supports de décision de niveau pro.

Risque : exécutables non audités ou dépendances malveillantes. Isolation via namespaces/containers et principe du moindre privilège. Gérer les secrets avec Vault ou SealedSecrets. Recommandations pratiques : sandboxing des runners, scan d’images (Trivy), politiques réseau Kubernetes (NetworkPolicy), règles pare‑feu restreintes, et audits réguliers des dépendances.

Checklist opérationnel (avant déploiement)

- Commits récents et issues suivies (<= 6 mois)

- Image Docker officielle signée disponible

- Manifests Kubernetes / docker‑compose prêts et testés

- Auth/TLS configurée et validée

- Scan d’image (Trivy) et scan CVE OK

- NetworkPolicy + pare‑feu appliqués

- Secrets dans Vault/SealedSecrets

- Test de charge pour latence & mémoire (RAG) passé

| Produit | Maintenu | Docker image | HTTP streamable | Use‑case conseillé |

| Qdrant | Oui (actif) | Oui (officielle) | Partiel (SDKs) | Vector DB pour RAG, recherche sémantique |

| Postgres / crystaldba | Postgres : oui / crystaldba : variable | Postgres : officielle | Non natif | Stockage relationnel + embeddings via extensions |

| GitHub MCP | Oui (GitHub maintained) | Oui (ghcr) | Oui | Workflows CI/CD et orchestration d’agents |

| Playwright MCP | Actif (équipe Playwright) | Oui | Non (contrôle browser) | Automation navigateur pour agents |

| Notion MCP | Varie (tiers) | Souvent non officiel | Non | Intégration docs, faible latence non critique |

Quels MCP pour stockage, mémoire et RAG

Pour RAG et mémoire priorisez des stores vecteurs et des bases relationnelles compatibles MCP (ex. Qdrant pour vecteurs, PostgreSQL via crystaldba pour context store, MongoDB).

Cas d’usage, points forts et limites :

- Qdrant (vecteurs) — idéal pour recherche sémantique, nearest-neighbor, reranking en pipeline RAG. Points forts : index HNSW, filtrage par payload, faible latence (ms). Limites : coût mémoire pour 100k+ vecteurs très gros (dépend dimension).

- PostgreSQL + crystaldba (context store relationnel) — idéal pour requêtes SQL directes, journaux, métadonnées, transactions ACID. Points forts : requêtes complexes, jointures, integrity. Limites : recherche sémantique native limitée (nécessite embedding + vecteur store ou extension pgvector).

- MongoDB — bon pour documents semi-structurés, pipelines d’agrégation en langage naturel via couche MCP; flexible, mais moins performant pour jointures complexes que PostgreSQL.

Types d’agents :

- Assistants de support → PostgreSQL + vecteur store (Qdrant) pour contexte + RAG.

- Agents d’analyse de docs → Qdrant + MongoDB (documents bruts + métadonnées).

- Recommender systems → Qdrant (embeddings) + PostgreSQL pour règles business.

Exemples techniques :

docker run -p 6333:6333 -p 6334:6334 --name qdrant -d qdrant/qdrant:latestversion: '3.8'

services:

postgres:

image: postgres:15

environment:

POSTGRES_PASSWORD: example

volumes:

- pgdata:/var/lib/postgresql/data

crystaldba:

image: crystaldba/mcp:latest

environment:

DB_URL: postgres://postgres:example@postgres:5432/postgres

depends_on:

- postgres

volumes:

pgdata:Appel HTTP streamable (exemple générique vers gateway MCP) :

POST /mcp/vector-search HTTP/1.1

Host: api.mcp.local

Authorization: Bearer YOUR_API_KEY

Accept: text/event-stream

Content-Type: application/json

{

"collection":"docs",

"vector":[0.12, -0.34, ...],

"top":5

}Sharding / réplication & coûts (ordre de grandeur, déploiement moyen 100k docs, 10 req/s) :

- Qdrant : 1-3 réplicas pour HA, sharding si >1M vecteurs. Infra recommandée : 8 vCPU / 32 GB RAM / NVMe 200 GB. Coût cloud ≈ 150–400 €/mois.

- PostgreSQL : primary + 1 replica, pgvector pour embeddings. Instance 4 vCPU / 16 GB / 100 GB ≈ 50–150 €/mois.

- MongoDB : replica set (3 nodes) si HA, VM 4 vCPU / 16 GB ≈ 100–300 €/mois.

| Technologie | Cas d’usage | Docker image dispo | Besoin GPU | Latence typique |

| Qdrant | Recherche sémantique, RAG | qdrant/qdrant:latest | Non (CPU suffit) / GPU optionnel pour embeddings | 10–50 ms |

| PostgreSQL (+crystaldba) | Stockage relationnel, requêtes SQL | postgres:15 + crystaldba/mcp:latest | Non | 5–50 ms |

| MongoDB | Docs semi-structurés, pipelines | mongo:6 | Non | 10–100 ms |

Quels MCP pour observabilité cloud, infra et dev

Utilisez MCPs spécialisés pour interroger et agir sur infra/observabilité (Kubernetes MCP, Grafana/Sentry/PagerDuty MCP, cloud providers MCPs) et MCPs dédiés dev/test (GitHub, Postman, Playwright) pour automatiser CI/CD et tests.

Introduction courte. Je préconise une séparation claire : MCPs observabilité/infra pour lire métriques, corréler et déclencher remédiations ; MCPs dev/test pour workflows CI/CD et E2E. Chaque agent doit utiliser le MCP adapté — ne pas centraliser tout sur un seul token.

- Actions possibles : création d’issues, déclenchement de runs/workflows, rollbacks, escalades d’incidents (PagerDuty), patchs K8s via Kubernetes MCP.

- Permissions nécessaires : principe de moindre privilège. Préférez des GitHub Apps (permissions granulaires) plutôt que des PAT larges. Tokens à rotation courte, scopes minimaux.

- Risques : permission excessive = exécution de code/modifs non souhaitées ; fuite d’incidents ou de logs sensibles via issue descriptions ; boucles de remediation automatiques mal calibrées.

Exemple concret. Un agent corrèle un crash Sentry (ID + stacktrace) avec le déploiement GitHub (SHA associé via tag). Il ouvre automatiquement une issue GitHub via le GitHub MCP, attache le lien Sentry, assigne le propriétaire du service et déclenche un workflow de test reproduisant l’erreur.

Config auth GitHub (recommandée) : préférez GitHub App avec permissions minimales :

- Issues : write

- Actions : write (pour déclencher workflows)

- Deployments : read

- Contents : read

- Metadata : read

Si PAT absolument nécessaire : scope minimal = repo (ou repo:public_repo), workflow (pour déclencher).

# Playwright MCP snippet pour lancer un test E2E via un agent

{

"mcp": "playwright",

"command": "npx playwright test --project=chromium --reporter=line",

"env": {

"BASE_URL": "https://staging.example.com",

"API_TOKEN_SECRET": "${SECRET_PLAYWRIGHT_TOKEN}"

}

}

| Integration | Actions (read/write) | Caution sécurité |

| Kubernetes MCP | read/write (pods, deployments) | RBAC strict, pas de cluster-admin global |

| Grafana / Sentry | read (logs/alerts) / write (annotations) | Masquer PII, tokens séparés |

| PagerDuty | write (escalation) | Limiter aux règles d’escalade |

| GitHub | read/write (issues, workflows) | Favoriser GitHub App, scopes minimaux |

| Playwright / Postman | trigger tests (write) | Secrets injection sécurisée |

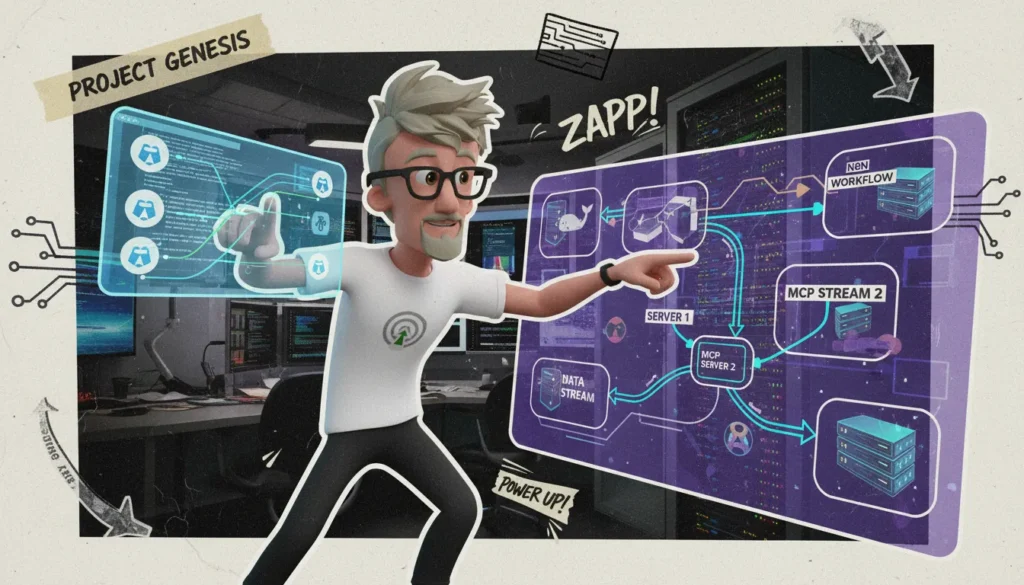

Comment orchestrer et exécuter des MCP avec n8n

orientez-vous vers n8n pour orchestrer MCPs en production via deux modèles — conteneurs compagnons (même réseau Docker) ou serveurs distants HTTP streamable.

Je décris clairement les deux approches, leur mise en œuvre dans n8n, et les règles à appliquer pour passer du prototype au run fiable.

| Conteneurs compagnons (Docker) |

|

| Serveurs distants HTTP streamable |

|

Utilisation du node MCP Client Tool dans n8n :

- Champs clés : URL, Method (POST/PUT/STREAM), Headers (Authorization, Content-Type), Body (JSON), Timeout et handling des streams (text/event-stream ou chunked).

- Activez reconnect et backoff dans les options avancées ; traitez les événements en continu avec un node Function pour idempotence.

Exemple docker-compose (n8n + Qdrant + MCP Postgres companion) :

version: '3.8'

services:

n8n:

image: n8nio/n8n:latest

environment:

- DB_TYPE=postgresdb

- DB_POSTGRESDB_HOST=postgres

- N8N_BASIC_AUTH_ACTIVE=true

- N8N_BASIC_AUTH_USER=admin

- N8N_BASIC_AUTH_PASSWORD=${N8N_PASSWORD}

ports: ["5678:5678"]

networks: [mcp-net]

qdrant:

image: qdrant/qdrant:latest

networks: [mcp-net]

volumes: ['./qdrant:/qdrant/storage']

mcp-postgres:

image: myorg/mcp-postgres:latest

environment:

- DATABASE_URL=postgres://user:pass@postgres:5432/db

networks: [mcp-net]

networks:

mcp-net:Exemple Remote pour n8n Cloud (webhook → MCP distant) :

Webhook URL: https://mcp.example.com/v1/stream

Headers:

Authorization: Bearer

Content-Type: application/json

Accept: text/event-stream

Reconnect logic (pseudo):

retry = exponential_backoff(base=1s, max=60s) with jitter

if 429 -> respect Retry-After header Bonnes pratiques :

- Gestion des secrets : variables d’environnement pour containers, HashiCorp Vault pour prod.

- Monitoring : N9K pour traces applicatives et Prometheus + Grafana pour métriques.

- Retries & idempotence : clés d’idempotence côté MCP, retry policy avec exponential backoff + full jitter.

Checklist (prototype → orchestré) :

- 1. Containeriser les MCP (images reproductibles)

- 2. CI build & scan d’images

- 3. Tests unitaires et E2E

- 4. Déployer en staging isolé

- 5. Configurer observability (traces, métriques, logs)

- 6. Canary / rollout progressif

- 7. Configurer secrets et rotation

- 8. Automatiser recovery & runbooks

Comment concevoir des workflows agentiques concrets et les mettre en prod

Introduction — Exemple concret : automatiser la création d’issues à partir d’emails avec validation humaine et sauvegarde mémoire.

- Workflow simple (testable) : Gmail → LLM → Discord H‑I‑T‑L → GitHub (MCP) → Notion (audit/mémoire).

Pipeline pas‑à‑pas

- Gmail Trigger (n8n) : configuration

- Type: Gmail Trigger

- Filtre: label = « to-issue »

- OAuth: token Google stocké dans n8n Credentials

- HTTP Request → LLM : prompt design (préciser rôle, sortie JSON schema)

- Method: POST, Body: { « prompt »: « … », « max_tokens »: 800 }

- Validation: JSON schema pour titre, description, severity

- MCP Client Tool (n8n) : configuration

- Endpoint: https://mcp.example.com/api/run

- Headers: Authorization: Bearer

, Accept: text/stream (si streaming) - Params: tool=memory.search, context=conversation_id

- Discord node : envoi pour validation H‑I‑T‑L (mention d’un rôle)

- Channel ID, Content = résumé + boutons (Approve/Reject) via components

- GitHub node : création d’issue via MCP

- Repo, Title, Body

- Payload exemple :

{

"title": "Bug: Résumé automatique - action requise",

"body": "Source: email from x\nLLM_summary: ...\nValidation: approved by @human",

"labels": ["triage","auto"]

}

- Notion node : sauvegarde mémoire/audit

{

"parent": { "database_id": "xxxx" },

"properties": {

"Title": { "title":[{"text":{"content":"Issue auto: Bug résumé"}}]},

"Source": {"rich_text":[{"text":{"content":"email@example.com"}}]},

"LLM_output": {"rich_text":[{"text":{"content":"..."} }]}

}

}

Créer un MCP server minimal dans n8n (no TypeScript)

- Utiliser MCP Server Trigger : exposer outils comme « gmail.read », « sheets.query ».

- Tools = JSON manifest : name, inputs, outputs, handler_endpoint (n8n workflow URL).

- Mapping : chaque call MCP → webhook n8n qui exécute la logique (read Gmail, query Sheets).

- Sécurité : OAuth2 pour Google (refresh token dans n8n Credentials), JWT pour authentifier n8n ↔ MCP.

Feuille de route 6 étapes pour industrialiser

- 1. Prototype & tests unitaires (LLM prompts, schemas).

- 2. Observabilité (logs structurés, traces, métriques LLM latence/coef de confiance).

- 3. Sécurité (scopes, rotation tokens, least privilege).

- 4. Scaling (workers n8n horizontaux, MCP autoscale, cache mémoire).

- 5. Runbook (validation, incidents, playbooks).

- 6. Rollback & canary deploys (feature flags pour agents).

| Étape | Composant MCP | Points de contrôle |

| Gmail → LLM | memory.search, prompt_pipeline | Filtres email, schema validation |

| H‑I‑T‑L | human_validation | Latency, audit trail, RBAC |

| Issue + Mémoire | github.create_issue, notion.append | Idempotence, token rotation |

Prêt à déployer vos premiers serveurs MCP et agents autonomes ?

Les serveurs MCP fiables sont ceux qui sont maintenus, docker‑ready et compatibles HTTP streamable : Qdrant, Postgres/crystaldba, implémentations officielles GitHub/n8n et autres MCP spécialisés couvrent stockage, observabilité, dev/test et ops. Orchestrer via n8n (companion containers ou remote stream) permet de prototyper vite puis industrialiser en appliquant sécurité, monitoring et CI. En suivant la feuille de route proposée et les bonnes pratiques d’isolation et d’authentification, vous réduirez les risques et gagnerez en réactivité : résultat concret, des agents reproductibles et exploitables en production pour accélérer votre business.

FAQ

A propos de l’auteur

Franck Scandolera — Fort de plus de 10 ans d’expérience en analytics, intégration et automatisation, je suis consultant, formateur et dirigeant de l’agence webAnalyste et de Formations Analytics. Expert en sGTM/GA4, BigQuery, dbt, Airbyte et automatisation IA avec n8n, je conçois et produis des architectures d’agents IA et des workflows data-to-action pour des entreprises en France, Suisse et Belgique. Basé à Brive‑la‑Gaillarde, je suis disponible pour vous aider à déployer MCPs et agents autonomes.