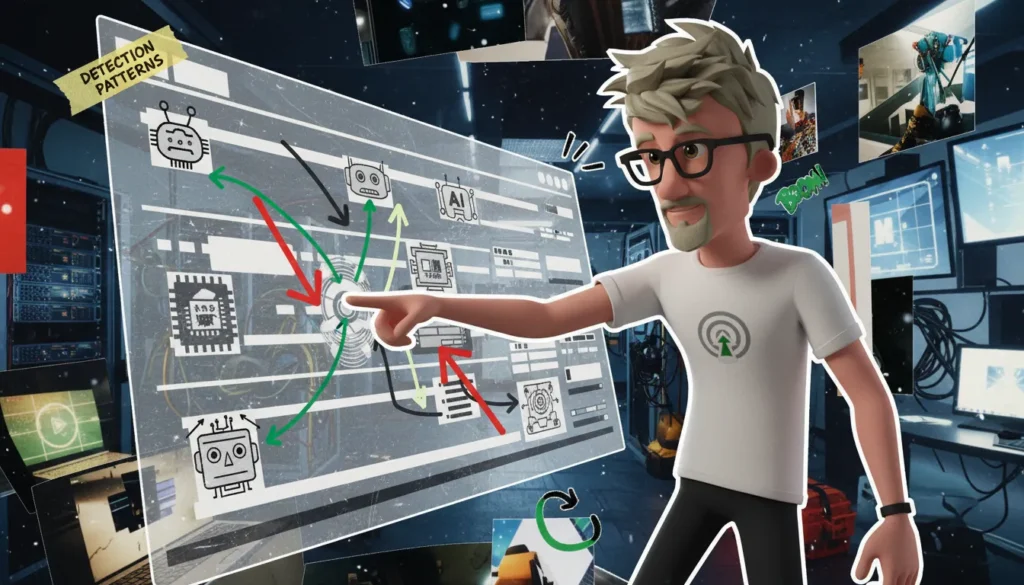

Le trafic IA mélange clics humains, visites automatisées et réponses sans clic, faussant les métriques si non distingué. Pour analyser correctement, segmentez par type (chatbots, crawlers, scrapers, agents) et appliquez détection server-side (voir Cloudflare, Imperva, documentation Matomo).

Quels types d’IA affectent le trafic web

Le trafic IA se répartit principalement en quatre familles : chatbots (answer engines), crawlers (automated readers), scrapers (targeted data collectors) et agents autonomes (digital assistants).

Chatbots / Answer Engines — Définition et exemples. Chatbots Fournissent des réponses directes à des requêtes utilisateur via une API ou un front (ex : ChatGPT, Perplexity, Google Answer/SERP). Signaux Distinctifs : referrer souvent absent ou « direct », user‑agent générique d’API, pattern de requêtes courtes et répétées.

- Indicateurs détectables :

- User‑Agent d’API (ex. OpenAI‑Client) visible dans les logs.

- Referrer vide ou « direct » dans Matomo/GTM.

- Rafales de requêtes identiques sur une courte période (pattern temporel).

- Impacts probables :

- Visites en hausse sans engagement réel (gonflement du trafic).

- Pages/session faibles si réponses statiques réutilisent la même page.

- Taux de conversion dilué car sessions non humaines.

Crawlers — Définition et exemples. Crawlers Indexent massivement le web pour moteurs ou archives (ex : Googlebot, Bingbot, crawlers publics). Signaux Distinctifs : user‑agent identifié, rythme régulier, respect parfois du robots.txt.

Intégrez l’IA Générative (GenAI) dans votre activité

Nos formations IA Générative (GenAI) et prompt engineering sont conçues pour les équipes qui veulent apprendre à exploiter les IA comme un pro. Vous y apprenez à structurer des prompts efficaces, à exploiter les meilleurs outils (assistants IA type ChatGPT, générateurs d’images, audio et vidéo) et à les appliquer à vos vrais cas métiers : analyser vos données (GA4, BigQuery, CRM…), produire des contenus clairs et crédibles, prototyper plus vite et automatiser les tâches répétitives. Des ateliers 100 % pratiques, pensés pour les entreprises, pour gagner du temps, sécuriser vos usages et livrer des analyses et supports de décision de niveau pro.

- Indicateurs détectables :

- User‑Agent officiel (Googlebot/Bingbot) dans server logs.

- Accès séquentiels à sitemap/robots.txt et pages profondes.

- Vitesse de crawl stable et rapprochée (intervalles réguliers).

- Impacts probables :

- Augmentation des pages vues par session (exploration profonde).

- Taux de rebond peu impacté si pages indexées correctement.

- Faible impact sur conversions directes mais charge serveur accrue.

Scrapers — Définition et exemples. Scrapers Collectent des données ciblées pour agrégation ou revente (ex : services commerciaux comme BrightData, scripts personnalisés). Signaux Distinctifs : user‑agent spoofé, motifs de requêtes répétitives ciblant mêmes endpoints, absence d’exécution JS.

- Indicateurs détectables :

- Répétition de requêtes vers les mêmes endpoints/API en logs.

- Absence de cookies ou storage JS dans sessions (pas d’exécution JS).

- Vitesse élevée et sessions longues sans interactions clavier/souris.

- Impacts probables :

- Pages/session artificiellement élevées si scraping profondeur.

- Taux de rebond peu fiable (sessions non interactives).

- Conversions nulles pour ces sessions, faussant le taux global.

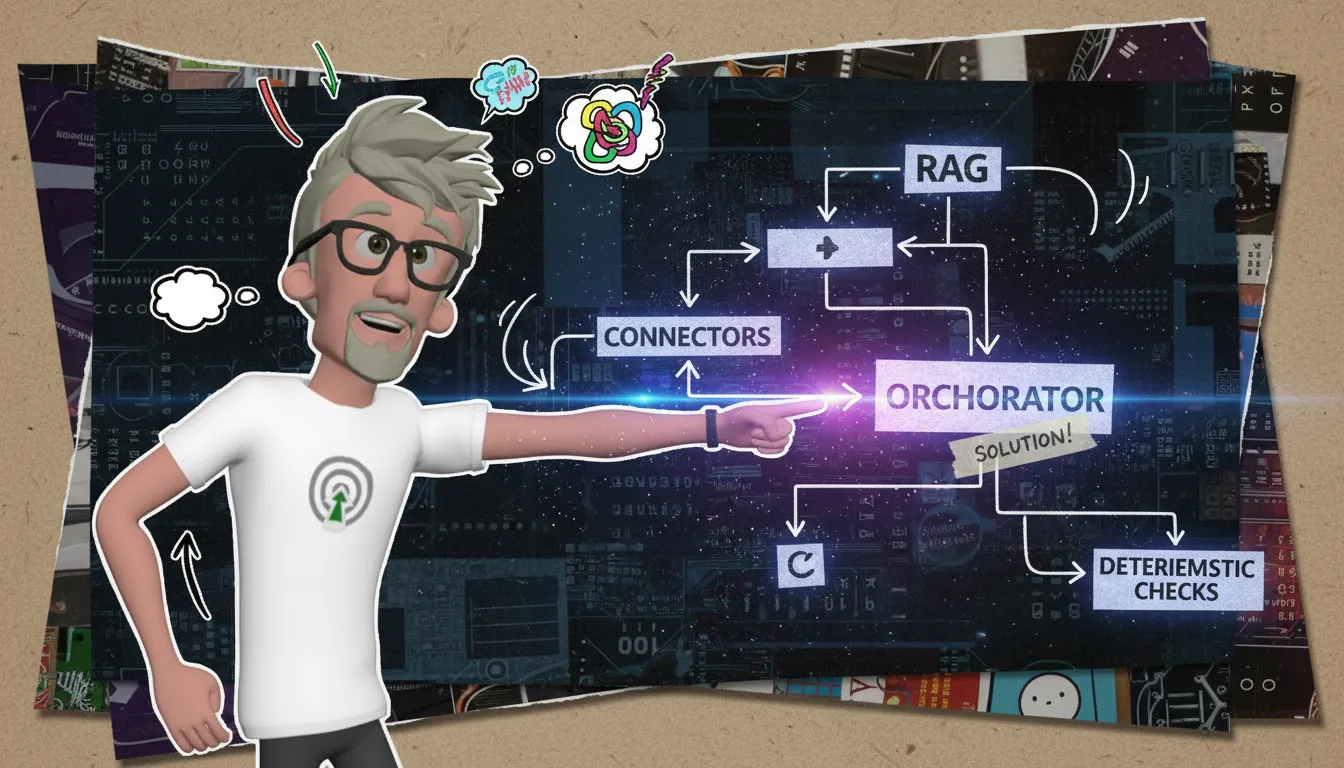

Agents autonomes — Définition et exemples. Agents Autonomes Exécutent des workflows complexes, combinent RAG (Retrieval‑Augmented Generation) et automations (ex : LangChain agents, Auto‑GPT, bots orchestrant Zapier+LLM). Signaux Distinctifs : pattern multi‑endpoint, exécution JS partielle, cookies présents mais interactions non humaines.

- Indicateurs détectables :

- Chaînes de requêtes multi‑endpoints dans un court laps de temps.

- Comportement hybride : exécution partielle de JS détectée via GTM/Matomo.

- Sessions longues avec interactions simulées (clics programmés).

- Impacts probables :

- Visites volumineuses et irrégulières, difficiles à filtrer.

- Pages/session et durée moyennes artificiellement élevées ou basses selon le workflow.

- Taux de conversion faussé par actions non‑humaines simulant parcours client.

Sources de référence : rapports Cloudflare Bot Management, études Imperva sur les bots, documentation Matomo pour l’analyse des logs et des user‑agents. Prochaine étape : plongeons dans le détail des chatbots et comment les repérer précisément dans vos analytics.

Comment les chatbots provoquent le zero click et parfois envoient du trafic

Les chatbots et answer engines fournissent souvent une réponse directe dans leur interface, créant du « zero-click » quand l’utilisateur obtient l’information sans visiter votre site. Certaines plateformes ajoutent pourtant un lien source ou un bouton « open source » qui renvoie et génère du trafic référent.

- Mécanismes des answer engines : Extrait de réponse (snippet) affiché directement, lien source pointant vers l’URL d’origine, et parfois un « source card » enrichi (titre, méta, image).

- Quand ils génèrent des clics : Présence d’un lien explicite, bouton « open », ou usage comme agrégateur où l’utilisateur veut lire l’article complet.

- Quand ils suppriment le clic : Réponse complète et satisfaisante dans l’interface, résumé factuel ou solution immédiate (code, recette, définition).

Pour détecter cette influence dans Matomo et dans les logs, capturez systématiquement le Referer HTTP et segmentez les domaines d’answer engines (exemples : perplexity.ai, duckduckgo.com, g.co). Analysez le temps avant clic (time-to-click) : un temps très court ou des sessions d’une seule page indiquent du zero-click. Repérez des pages avec baisse de visites malgré un bon positionnement SEO.

# Segment Matomo (pseudocode)

segment = WHERE referrer_hostname IN ("perplexity.ai","duckduckgo.com","g.co")

AND visit_count > 0# Extrait de log HTTP

192.0.2.10 - - [07/Apr/2026:10:12:34 +0200] "GET /article.html HTTP/1.1" 200 5234 "https://perplexity.ai/search?query=mon+article" "Mozilla/5.0 (compatible)"

- Recommandation 1 : Implémentez un traçage côté serveur (server-side tracking) pour capturer les hits même sans exécution JS.

- Recommandation 2 : Enrichissez l’attribution avec les referers complets et UTM synthétiques lors de partages.

- Recommandation 3 : Ajoutez des événements de scroll et de lecture pour mesurer l’engagement hors clics.

- Recommandation 4 : Créez des segments Matomo pour isoler les pertes de trafic par page et par requête.

- Recommandation 5 : Testez des micro-contenus incitatifs dans les snippets (CTA clairs) pour transformer certaines impressions en visites.

Sources recommandées : Matomo Docs (https://matomo.org/docs/), Matomo Referrers (https://matomo.org/docs/referrer-types/) et l’étude SparkToro sur le « zero-click » (https://sparktoro.com/blog/zero-click-searches/).

Comment différencier crawlers et scrapers dans vos logs

Les crawlers parcourent systématiquement et à grande échelle tandis que les scrapers ciblent et extraient des éléments précis ; cette différence explique leurs empreintes distinctes dans les logs.

Comportements typiques.

- Comportement de crawlers : Navigation séquentielle sur les sitemaps, respect du robots.txt, crawl-delay entre requêtes, patterns réguliers de profondeur de pages.

- Comportement de scrapers : Rafales de requêtes sur pages spécifiques, ciblage de sélecteurs CSS/ID, enchaînement de HEAD/GET répétés pour détecter changements, souvent pas de respect de robots.txt.

Signaux pratiques à surveiller.

- User-agent pattern : Chaînes génériques ou imitées, parfois sans version ou avec tokens bizarres.

- Fréquence IP : Volume de requêtes élevé en courtes fenêtres temporelles.

- Page depth : Crawlers progressent en profondeur, scrapers restent sur quelques endpoints.

- Ratio assets/HTML : Bots non-exécutant le JS demandent beaucoup d’HTML et peu d’assets (CSS/JS/images).

- Absence d’exécution JS et cookies refusés : Indicateur fort de robot non-navigateur.

Script Python (pandas) pour détecter IPs à haute fréquence et score de suspicion.

import pandas as pd

# Lecture d'un log CSV minimal: timestamp,ip,method,uri

df = pd.read_csv('access_log.csv', parse_dates=['timestamp'])

window = '1min'

counts = df.set_index('timestamp').groupby('ip').resample(window).size().reset_index(name='reqs')

score = counts.groupby('ip')['reqs'].max().reset_index()

score['suspicion'] = (score['reqs'] - score['reqs'].mean())/score['reqs'].std()

score.to_csv('ip_suspicion.csv', index=False)Exemples de regex pour filtrer user-agents suspects.

# Quelques regex utiles (compatible PCRE)

# Agents génériques

/^(?:Apache-HttpClient|Java\/|python-requests|curl|Wget|Go-http-client)/

# Bots malformés sans slash/version

/^[A-Za-z]{3,20}\s*$/

# Chaînes contenant "bot" mais pas "bing" ou "google"

/(?i)\bbot\b(?!.*(bing|google))/Configuration Nginx pour bloquer ou tagger les bots (exemple).

# Détection simple par user-agent et ajout d'en-tête

map $http_user_agent $is_suspected_bot {

default 0;

"~(?i)^(?:curl|wget|python-requests|java\/|apache-httpclient)" 1;

}

server {

...

if ($is_suspected_bot = 1) {

add_header X-Bot-Flag "1";

return 403;

}

}Sources techniques : Imperva bot management, Cloudflare Bot Management, Matomo docs.

| Indicateur | Action recommandée | Priorité |

| Haute fréquence IP | Bloquer temporairement / challenge (CAPTCHA) / surveiller | Élevée |

| User-agent suspect | Tagger via en-tête, enrichir liste regex, analyser | Moyenne |

| Absence d’exécution JS | Servir version allégée, marquer comme bot probable | Moyenne |

| Rafales sur mêmes endpoints | Throttle / WAF rules / bannissement IP | Élevée |

Que font les agents autonomes et quels risques posent-ils

Les agents autonomes exécutent des tâches après une instruction initiale et peuvent simuler des sessions humaines ou accomplir actions sans supervision, augmentant la complexité analytique et le risque d’automatisation malveillante.

Ils effectuent des actions variées et répétitives à grande échelle.

- Recherche multi-sources : Requêtes simultanées sur plusieurs moteurs, agrégation de contenus et extraction structurée (scraping).

- Remplissage de formulaires : Soumission automatique de formulaires pour tester, frauder ou créer comptes en masse.

- Comparaisons et arbitrage : Surveillance de prix et exécution d’achats pour arbitrage ou scalping.

- Achats automatisés : Checkout automatique, utilisation de cartes volées ou de bots de réservation (tickets, stock limité).

Ils imitent le comportement humain grâce à plusieurs techniques techniques sophistiquées.

- Exécution JavaScript complète : Utilisation de navigateurs sans tête (headless) capables d’interpréter JS pour reproduire les actions côté client.

- Gestion de cookies et stockage local : Persistance d’identifiants et rotation de cookies pour maintenir des sessions persistantes.

- Simulation de latence humaine : Introductions d’attentes aléatoires, mouvements de souris simulés et séquences d’interaction.

- Imitation devices : Rotation d’empreintes (user-agent, résolutions, fonts) et proxys pour diversifier l’origine.

Six méthodes pratiques de détection et mitigation.

- Server-side fingerprinting : Calcul d’empreinte serveur (entropie header+tls+timings) plus fiable que le simple user-agent.

- Honeypots : Champs/formulaires invisibles pour piéger les bots qui remplissent systématiquement.

- Challenge côté serveur (CAPTCHA conditionnel) : Activer uniquement si le score de risque dépasse un seuil pour limiter la friction.

- Rate limiting : Limiter les actions par IP/empreinte et appliquer backoff progressif.

- Validation côté serveur des conversions : Vérifier la cohérence des achats/conversions (adresse, CVV, device fingerprint) avant attribution.

- Logs enrichis pour attribution : Conserver headers bruts, timings, chaines IP/proxy pour post-mortem et machine learning.

Exemple de workflow n8n (étapes résumées).

- 1. Trigger HTTP : Nouvelle session ou événement web côté serveur envoie payload à n8n.

- 2. Scoring : Appeler service interne de fingerprinting pour obtenir un score de risque.

- 3. Enrichissement Geo/IP : Appeler IPinfo ou MaxMind pour récupérer pays, ASN, proxy flag.

- 4. Logique conditionnelle : Si score> seuil, alors notifier et marquer.

- 5. Alerte : Envoyer message Slack/Email avec détails (sessionId, score, geo).

- 6. Marquage Matomo : Appeler l’API Tracking Matomo pour ajouter une dimension personnalisée « suspect=1 ».

GET https://matomo.example/matomo.php?idsite=1&rec=1&url=https://votre.site/page&uid=USER_ID&dimension1=suspectChecklist opérationnelle pour analytics et sécurité.

- Instrumenter logs : Activer collecte headers, timings, TLS fingerprints.

- Déployer scoring : Mettre en place un score de risque centralisé.

- Automatiser réponses : CAPTCHA conditionnel, rate limit dynamique.

- Enrichir données : Intégrer MaxMind/IPinfo et ASN dans les pipelines.

- Surveiller conversions : Valider côté serveur avant attribution marketing.

- Organiser post-mortem : Réserver playbooks et preuves pour investigations.

Comment mesurer et corriger l’impact de l’IA sur vos métriques

Pour mesurer et corriger l’effet de l’IA sur vos métriques, segmentez le trafic, appliquez un filtrage server-side et adaptez vos KPI : ce sont les actions concrètes à mener immédiatement.

- 1. Instrumentation server-side : Capturer les requêtes visibles par les bots depuis le serveur plutôt que côté client pour éviter le bruit JavaScript. Exemple : Matomo Server‑Side Tagging ou proxy d’API qui envoie des hits signés au collecteur.

- 2. Création de segments : Séparer visiteurs humains, referrals IA (ex. extraits générés par ChatGPT/Bard), crawlers, scrapers et agents automatisés pour isoler l’impact.

- 3. Tests et validation : Déployer honeypot pages non indexées, injecter tokens JS uniques et analyser les sessions qui les retournent pour détecter l’automatisation.

- 4. Reporting adapté : Remplacer métriques globales par KPIs qualifiés (conversions par source humaine, valeur par visite qualifiée, taux d’engagement pondéré).

| Type d’IA | Impact probable | Actions recommandées |

| Agents de recherche (ex. crawlers IA) | Augmentation des hits, fausse hausse du trafic | Filtrage server-side, marquage des sessions, blocage sélectif |

| Réponses/referrals IA (ex. snippets) | Trafic sortant faible en clics, sources référentes ambiguës | Enrichissement UTM, suivi des conversions par source humaine |

| Scrapers et bots de résumé | Sessions courtes, taux de rebond gonflé | Honeypots, token JS, blocage par WAF |

Exemples de règles Matomo / regex :

#1 Exclure user-agents bots

/^.*(bot|spider|crawler|slurp|bingpreview|curl).*$/i

#2 Filtrer referrals IA connus

/^https?:\/\/(chatgpt|bard|perplexity|phind)\./iExemple de requête d’API serveur pour marquer une session comme ‘bot’ :

POST /api/v1/sessions/mark

Authorization: Bearer

Content-Type: application/json

{

"session_id": "abc123",

"tags": ["bot"],

"reason": "detected_via_honeypot"

} Huit mesures prioritaires à déployer immédiatement :

- Activer tracking server-side pour tous les endpoints critiques.

- Déployer regex et listes d’UA pour filtrer les bots connus.

- Créer segments distincts dans l’outil analytics pour trafic humain et non-humain.

- Installer honeypots et tokens JS pour valider l’automatisation.

- Mettre en place marquage API pour sessions suspectes depuis le pipeline.

- Mettre à jour les dashboards pour KPIs qualifiés (valeur/visite qualifiée).

- Appliquer règles WAF pour bloquer scrapers agressifs.

- Documenter et automatiser tests de régression des filtres chaque semaine.

Prêt à différencier trafic humain et trafic IA pour des analyses fiables ?

Le trafic IA regroupe chatbots, crawlers, scrapers et agents autonomes, chacun laissant des traces spécifiques : clics référents, réponses sans clic, visites automatisées ou sessions simulées. Pour restaurer la fiabilité de vos métriques, segmentez le trafic, instrumentez server-side, appliquez règles de détection et automatisez les alertes. Ces actions réduisent les faux positifs, améliorent l’attribution et protègent la prise de décision business — vous obtenez des données exploitables et des KPI plus proches de la réalité.

FAQ

A propos de l’auteur

Franck Scandolera — expert & formateur en Tracking avancé server-side, Analytics Engineering, Automatisation No/Low Code (n8n), intégration de l’IA en entreprise et SEO/GEO. Responsable de l’agence webAnalyste et de l’organisme de formation ‘Formations Analytics’. Réf. clients : Logis Hôtel, Yelloh Village, BazarChic, Fédération Française de Football, Texdecor. Dispo pour aider les entreprises => contactez moi.