Maîtriser l’ingénierie LLM impose d’orchestrer gestion du contexte, appels d’outils, MCP, agents, mise en cache sémantique et compression contextuelle pour rendre un modèle réellement productif. Lisez ce guide structuré pour appliquer ces concepts et réduire latence, coûts et erreurs opérationnelles.

Qu’est-ce que l’ingénierie du contexte

L’ingénierie du contexte consiste à contrôler précisément ce que voit le modèle (instructions système, historique, documents récupérés, définitions d’outils, mémoire et étapes intermédiaires) et dans quel ordre.

Le choix de l’ordre, du format et de la sélection est souvent plus décisif que la reformulation d’une invite parce que le modèle ne « comprend » que la séquence et la priorité des informations qu’on lui fournit. Une instruction système en tête fixe le cadre ; des documents mal triés introduisent du bruit qui dilue la signalisation ; un bon formatage facilite l’extraction et réduit les tokens consommés.

- Checklist pour construire un contexte : Priorisez les éléments suivants dans cet ordre : instructions système > définitions d’outils > mémoire pertinente > documents récupérés > historique utilisateur.

- Limites de tokens : Contrôlez le budget total, réservez 20–30% pour la réponse si la sortie doit être longue.

- Stratégie de troncature : Coupez d’abord l’historique ancien, puis les fragments de documents les moins pertinents ; préservez toujours l’instruction système.

- Format : Normalisez en JSON ou sections balisées pour faciliter le parsing automatique par le modèle.

{

"messages": [

{"role": "system", "content": "Contrainte: réponds en français, concis, factuel."},

{"role": "tool_definitions", "content": [{"name":"search","desc":"Recherche docs via vecteurs"}]},

{"role": "retrieved_docs", "content": [{"id":"doc1","text":"Résumé du document…","score":0.92}]},

{"role": "memory", "content": [{"type":"preference","value":"préfère réponses courtes"}]},

{"role": "user_history", "content": [{"role":"user","text":"Question précédente…"}]},

{"role": "user", "content": "Nouvelle question: comment faire X ?"}

]

}Pour sélectionner des fragments : combinez score de similarité (vecteurs), heuristiques textuelles (titres, entêtes, date, auteur) et métadonnées. Préférez les fragments avec score élevé et titres correspondants ; si incertain, gardez moins de fragments mais plus pertinents.

Intégrez l’IA Générative (GenAI) dans votre activité

Nos formations IA Générative (GenAI) et prompt engineering sont conçues pour les équipes qui veulent apprendre à exploiter les IA comme un pro. Vous y apprenez à structurer des prompts efficaces, à exploiter les meilleurs outils (assistants IA type ChatGPT, générateurs d’images, audio et vidéo) et à les appliquer à vos vrais cas métiers : analyser vos données (GA4, BigQuery, CRM…), produire des contenus clairs et crédibles, prototyper plus vite et automatiser les tâches répétitives. Des ateliers 100 % pratiques, pensés pour les entreprises, pour gagner du temps, sécuriser vos usages et livrer des analyses et supports de décision de niveau pro.

La mémoire courte contient le contexte sessionnel immédiat ; la mémoire longue stocke préférences, faits stables ou historiques multi-sessions. Matérialisez la mémoire en embeddings si vous devez faire des recherches sémantiques fréquentes, et placez-la dans un store externe (vecteurs) si elle dépasse quelques milliers de tokens.

- Trop d’informations brutes (bruit) : Remédiation : filtrer par similarité, résumer les documents, et supprimer redondances.

- Ordre inapproprié : Remédiation : mettre l’instruction système et définitions d’outils en tête, puis les sources classées par pertinence.

| Élément du contexte | Rôle | Bonnes pratiques |

| Instruction système | Cadre et contraintes | Toujours en tête, concise et précise |

| Définitions d’outils | Capacités et API | Documenter champs et limites |

| Documents récupérés | Sources de vérité | Filtrer, résumer, ordonner par pertinence |

| Mémoire | Historique et préférences | Embeddings pour recherche, expirer si obsolète |

Comment intégrer les appels d’outils et le Model Context Protocol

L’appel d’outils permet au LLM d’agir au-delà du texte et le MCP standardise l’exposition d’outils et données pour réutilisabilité.

Qu’est‑ce qu’un appel d’outil et pourquoi c’est essentiel. Un appel d’outil déclenche une action externe (recherche web, requête BD, exécution de code, appel d’API) pour enrichir la réponse du modèle avec des données fraîches ou des capacités opérationnelles. Un système sans appels d’outils reste purement génératif et perd en précision, traçabilité et valeur opérationnelle.

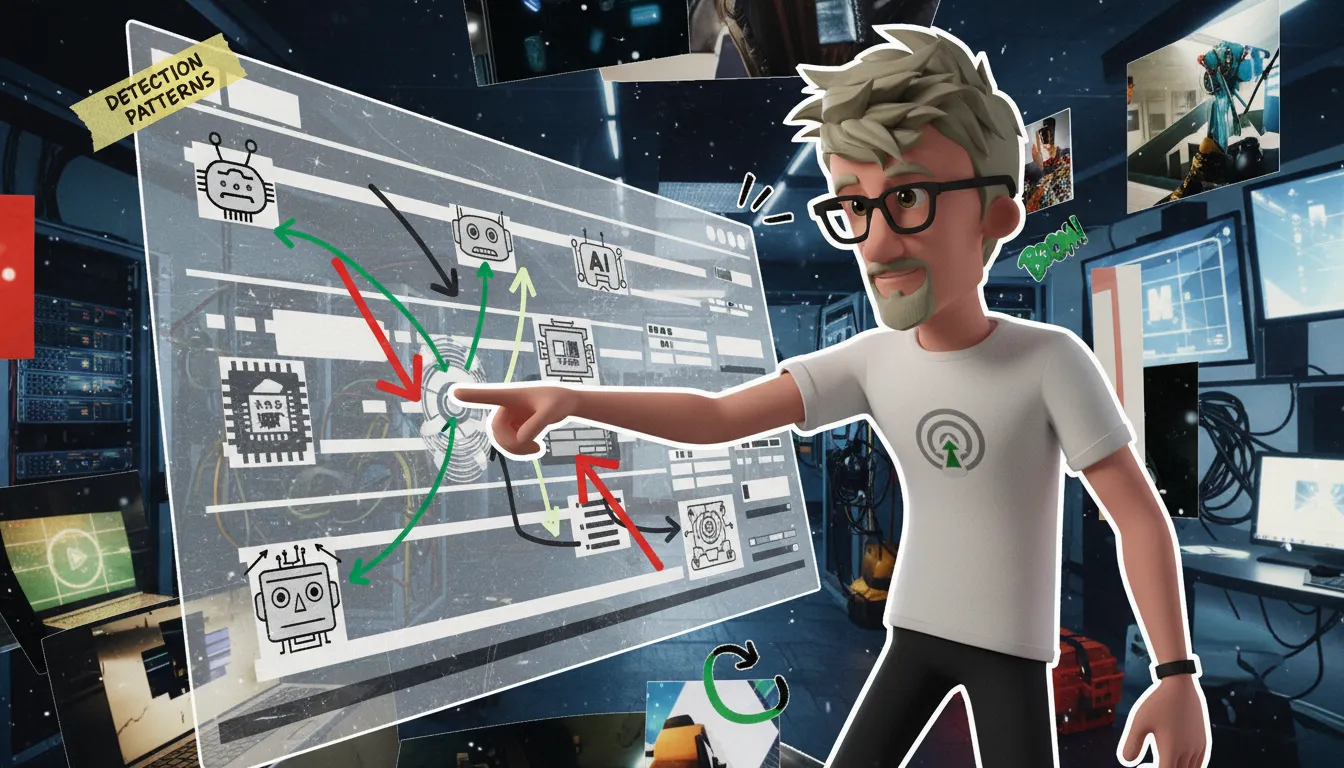

Implémentation technique — flux minimal. Détection d’intention par le LLM → Formation d’un appel fonction (schema) → Exécution côté serveur → Retour structuré au modèle pour finalisation.

# Pseudo-Python côté serveur (simplifié)

def handle_model_output(model_output):

# Détection d'intention (pattern ou slot filling)

if "search:" in model_output:

params = extract_params(model_output)

# Construction de l'appel de fonction selon schema JSON

result = call_tool("web_search", params)

# Retour structuré au modèle

return {"tool": "web_search", "status": "ok", "payload": result}

return {"tool": None}

# Exemple de schema de fonction (JSON)

{"name":"web_search","description":"Recherche web spécialisée","parameters":{"type":"object","properties":{"query":{"type":"string"},"limit":{"type":"integer"}},"required":["query"]}}

Le Model Context Protocol (MCP). But principal : interopérabilité et réutilisabilité entre modèles, outils et clients. Éléments standards : description d’outils, endpoints, types de données, workflows et contrats d’entrée/sortie.

# Exemple minimal MCP (JSON)

{"tools":[{"name":"web_search","endpoint":"/search","inputs":"query","outputs":"results"}],"datasources":[{"name":"crm","type":"sql","readOnly":true}],"workflows":[{"name":"customer_insight","steps":["crm.query","web_search","aggregate"]}]}

Impacts opérationnels. Sécurité : sanitation d’input, scopes et permissions, validation des réponses. Observabilité : logs d’appels, traces distribuées, métriques d’erreur. Testing : mocks d’outils, sandboxing pour exécutions dangereuses, tests d’intégration end‑to‑end.

Checklist MCP pour intégration et éviter le lock‑in.

- Définir des schemas versionnés pour chaque outil.

- Exiger endpoints auto‑décrits (OpenAPI/JSON‑LD).

- Prévoir adaptateurs pour wrappers propriétaires.

- Automatiser mocks et tests de conformité MCP.

- Standardiser auth (OAuth2, scopes) et rotation de clés.

| Critère | Approche custom | Approche MCP |

| Risques | Verrous, incompatibilités, dette technique | Interopérabilité, exigences de gouvernance |

| Coûts d’intégration | Faible démarrage, coût croissant | Investissement initial, économies long terme |

| Réutilisabilité | Faible | Élevée |

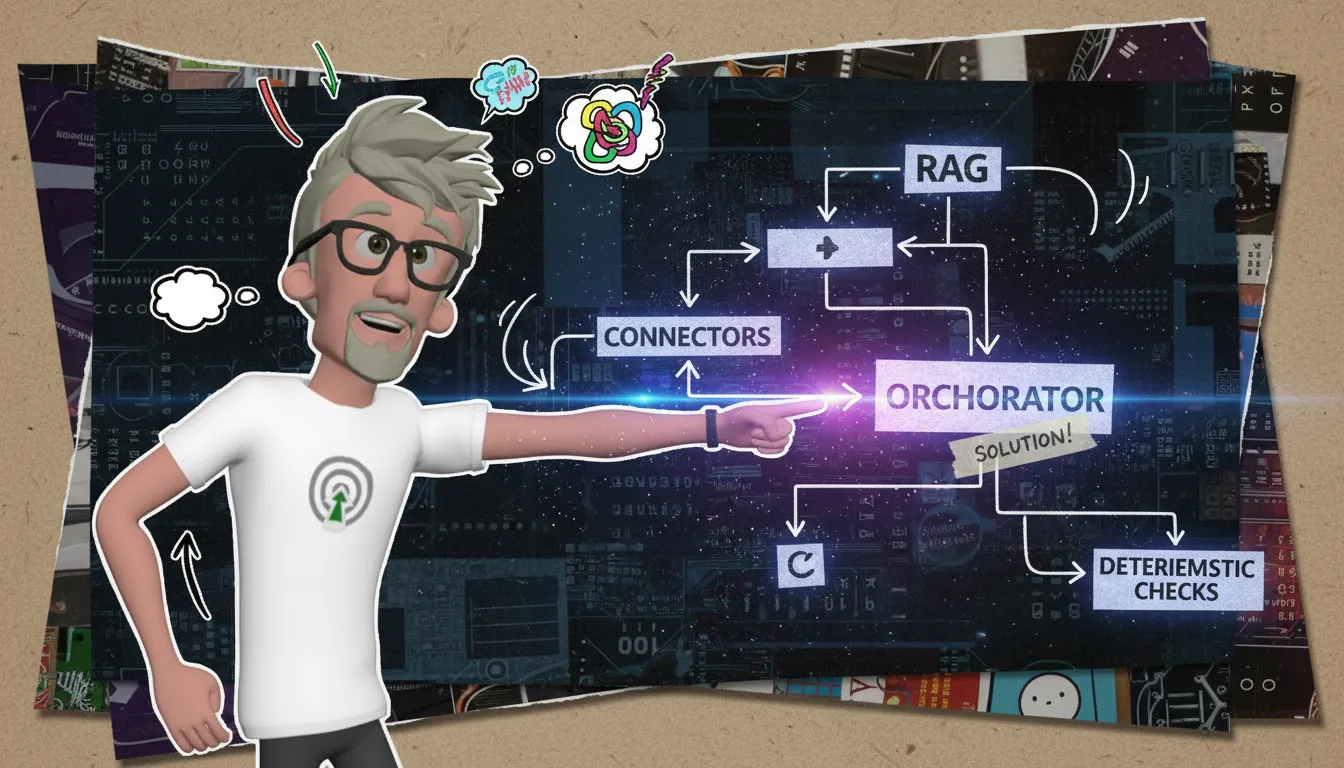

Comment orchestrer agents et communication agent à agent

L’orchestration multi-agent structure la coopération entre agents spécialisés (recherche, planification, exécution) via des protocoles A2A sécurisés, améliorant modularité et robustesse.

Définition d’un agent : Un agent est une entité logicielle responsable d’un rôle précis, conservant un état local et opérant avec des permissions explicites.

Voici des exemples d’agents spécialisés :

- Agent Recherche : Interroge bases de connaissances et récupère données pertinentes.

- Agent Planification : Élaborer séquences d’actions et gérer dépendances temporelles.

- Agent Exécution : Exécute commandes sur des systèmes cibles avec rollback.

- Agent Validation : Vérifie conformité, sécurité et résultats.

- Agent Observabilité : Agrège logs, traces et métriques.

Architecture recommandée : Mettre en place un bus de messages léger, un broker pour routage durable, et des contrats d’interface (API schemas/IDL) pour chaque capability.

Chaque composant doit inclure gestion des erreurs, timeouts et fallback policies afin d’éviter cascade failures.

Exemple de flux A2A (pseudo-JSON) :

{

"msg_id": "uuid-1234",

"from": "agent_planner",

"to": "agent_executor",

"capability": "execute_task",

"context_snapshot": {"task_id":"T-42","params":{"target":"svc-1"}},

"timestamp": "2026-04-07T12:00:00Z",

"auth": {"token":"eyJhb...","signature":"ablabla"}

}

Validation d’authenticité se fait via vérification de token, correspondance du agent_id et validation du context_snapshot par l’agent destinataire.

Bonnes pratiques de sécurité et confinement : Appliquer scopes et permissions minimales, valider strictement entrées/sorties, signer tous les messages, isoler agents sensibles dans sandboxes, et limiter capacités réseau et filesystem.

Stratégies d’orchestration : Comparer orchestrateur centralisé et chorégraphie distribuée :

- Orchestrateur Centralisé : Contrôle global, ordonnancement simple, mais point de défaillance unique.

- Chorégraphie Distribuée : Résilience et scalabilité accrues, mais complexité de coordination et debug plus élevée.

Tests et monitoring : Conserver chaînes d’audit immuables, permettre replay des échanges pour débogage, et suivre métriques clés : latence inter-agent, taux d’erreur, throughput, profondeur des files et SLA par agent.

| Style d’orchestration | Latence | Résilience | Complexité opérationnelle |

| Centralisé | Faible à moyen | Moyenne (point de défaillance) | Faible à moyen |

| Chorégraphie distribuée | Moyenne à élevée | Élevée | Élevée |

Quand et comment utiliser la mise en cache sémantique

la mise en cache sémantique réutilise réponses pertinentes pour requêtes proches afin de réduire latence et coûts, mais demande des critères de similarité et invalidation rigoureux.

Principe général : Embeddings numériques représentent texte en vecteurs. Ces vecteurs sont indexés dans une base vectorielle pour retrouver des réponses précédemment calculées proches de la requête actuelle.

Scénarios adaptés avant la liste de cas d’usage :

- FAQ fréquentes : Réponses stables à des questions répétées.

- Requêtes similaires dans l’historique utilisateur : Variantes phrastiques d’une même intention.

- Étapes stables de workflows : Parties déterministes d’un processus (validation, instructions standards).

- Scénarios à éviter : Requêtes critiques ou sensibles exigeant données fraîches, comme tarification en temps réel, dossiers médicaux ou décisions juridiques.

Architecture technique : Stocker le cache dans une vector DB (ex. FAISS, Milvus, Pinecone, Weaviate) pour requêtes nearest-neighbor rapides. Conserver métadonnées essentielles : timestamp de création, version du modèle (model_version), signature du contexte (context_signature), source/origin_id, score initial de confiance. Mettre en place invalidation par TTL, versioning (incrémenter context_signature quand le prompt/template change) et signaux de changement (webhook sur update de données).

Exemple de pseudo-code :

# Calculer embedding de la requête

query_vec = embed(request.text)

# Rechercher voisins

neighbors = vector_db.search(query_vec, k=5)

# Filtrer par seuil

best = max(neighbors, key=lambda n: n.score)

if best.score >= THRESHOLD and best.metadata.model_version == current_model:

return best.response # Réutiliser

else:

response = call_llm(request)

vector_db.upsert(embed(response.text), metadata={...})

return responseStratégies rappel vs précision : Ajuster seuils de similarité selon coût/risque, utiliser fuzzy matching sur context_signature pour tenir compte d’ajouts mineurs, et prévoir une politique de fallback systématique vers réexécution LLM en cas d’incertitude.

Impacts opérationnels : Réduction directe des appels coûteux et de la latence pour les hits. Attention aux biais et stale data qui peuvent propager réponses obsolètes. Implémenter monitoring hit/miss, latence, taux de réutilisation et qualité (A/B ou human-in-the-loop).

| Use Case | Approche de cache | Risque principal | Mitigation |

| FAQ | Cache fort + TTL long | Réponse obsolète | TTL + signal de purge sur mise à jour |

| Workflow interne stable | Index mémoire + versioning | Incohérence après changement de template | Context_signature et invalidation automatique |

| Tarification temps réel | Pas de cache ou TTL très court | Décision incorrecte | Forcer re-run et vérifier source de vérité |

Comment compresser le contexte efficacement en production

la compression contextuelle consiste à réduire du contenu volumineux en extraits pertinents ou représentations condensées afin d’optimiser l’utilisation des tokens et la pertinence des réponses.

Distinction essentielle : La compression extractive consiste à sélectionner des passages originaux pertinents sans les reformuler, tandis que la compression abstractive génère des résumés nouveaux via un LLM ou des représentations composées d’embeddings.

- Flux opérationnel recommandé : Récupération → Scoring → Extraction → (Optionnel) Résumé → Insertion dans le contexte.

- Récupération : Récupération de documents ou chunks pertinents via index ou moteur de recherche.

- Scoring : Classement par similarité sémantique (embeddings) ou heuristiques TF-IDF.

- Extraction : Prise des passages top-k selon budget token.

- Résumé optionnel : Réduction supplémentaire via LLM pour consolider plusieurs passages en un paragraphe court.

Exemple de prompt LLM pour résumé extractif :

Extraire les 3 phrases les plus pertinentes dans ce texte qui répondent à la question : "". Répondre uniquement par ces phrases, sans ajout. Pseudo-code pipeline similarity :

# Charger embeddings

chunks = chunk_document(doc, 500) # tokens

embs = embed(chunks)

query_emb = embed(query)

scores = cosine_similarity(query_emb, embs)

top_chunks = select_top_k(chunks, scores, k=8)Exemple de compactage multi-doc via deuxième requête LLM :

Entrée : concaténation des top_chunks (max 1500 tokens)

Prompt : "Fusionner ces extraits en un paragraphe de 80-120 mots, garder les faits et citer entre crochets l'origine (docX:pageY) pour chaque phrase." - Critères de qualité : Préservation des faits vérifiables, Traçabilité vers la source (métadonnées), Seuils de confiance (p.ex. similarité > 0.78).

- Cas pratique : Pour 10+ pages, chunker à 400–600 tokens, récupérer top 20 chunks, résumer chaque chunk en 1-2 phrases puis synthétiser à 150 mots. Ce workflow réduit typiquement 90% des tokens tout en gardant les faits clés.

- Coûts/latence : Compression ajoute coût CPU/req LLM mais réduit tokens pour l’inference principale; trade-off favorable si réduction token > 30% ou pour SLAs de latence.

| Méthode | Coût/Complexité | Qualité de préservation des faits | Cas d’usage conseillé |

| Extractive | Faible | Élevée | Réponses factuelles, traçabilité |

| Abstractive (LLM) | Moyen à élevé | Moyenne (attention hallucinations) | Synthèses courtes, UX conviviale |

| Embeddings composites | Moyen | Élevée si sources multiples liées | Recherche documentaire, reranking |

Prêt à transformer vos LLM en systèmes productifs et robustes ?

L’ingénierie LLM exige d’abandonner l’idée d’une simple invite et d’adopter un système : gestion fine du contexte, appels d’outils standardisés via MCP, orchestration multi-agents, cache sémantique et compression contextuelle. Appliqués ensemble, ces leviers réduisent latence et coûts, augmentent la robustesse et rendent vos modèles exploitables en production. Vous gagnez en prédictibilité opérationnelle et en qualité d’usage — prêtez-vous à franchir le pas pour des gains mesurables.

FAQ

A propos de l’auteur

Je suis Franck Scandolera, expert et formateur en tracking server-side, Analytics Engineering, automatisation No/Low Code (n8n), intégration de l’IA et SEO/GEO. Responsable de l’agence webAnalyste et de l’organisme de formation Formations Analytics, j’accompagne des clients comme Logis Hôtel, Yelloh Village, BazarChic, Fédération Française de Football et Texdecor. Disponible pour aider les entreprises à industrialiser leurs LLM et pipelines IA — contactez-moi.