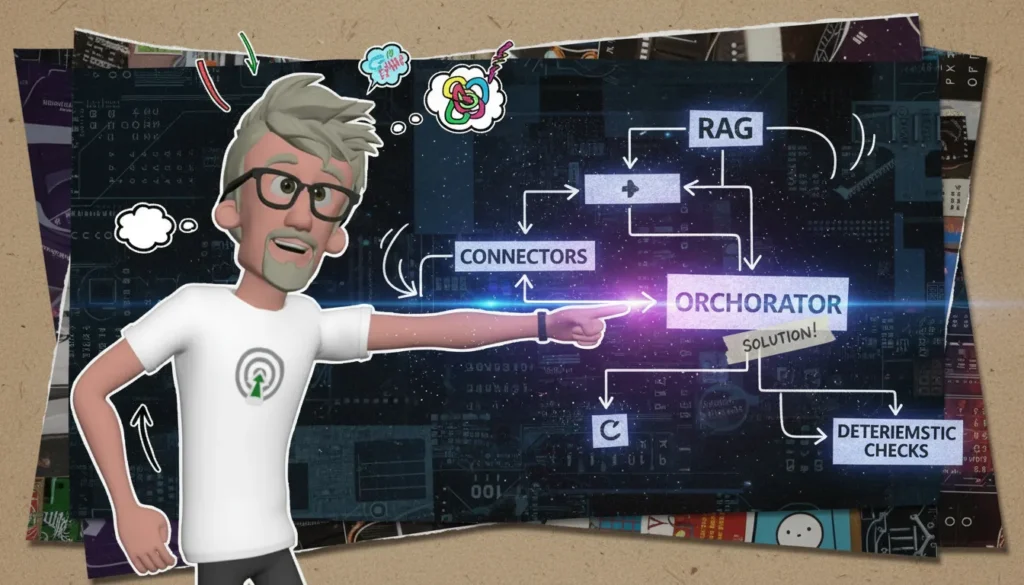

En 2026, les briques fondamentales (RAG, mémoire, connecteurs, recherche web) sont majoritairement natives des LLM-as-a-service; l’avantage se situe désormais dans l’orchestration, le déterminisme et l’évaluation. Je décrypte les critères pratiques pour choisir et évaluer une plateforme d’agents.

Qu’est-ce qui a changé depuis 2025

Réponse courte : l’essentiel s’est commoditisé — de nombreuses capacités agents (RAG, memory, connecteurs, recherche web, skills/templates) sont désormais proposées nativement par les services LLM, réduisant la valeur des briques de base et déplaçant la différenciation vers l’orchestration, le contrôle et l’évaluation.

Évolution 2025→2026. Les offres LLM-as-a-service intègrent désormais l’upload/doc context (contexte par documents chargés), les connectors/apps (plugins vers CRM, messageries, bases de données), les skills/templates (composants réutilisables pour tâches courantes), la recherche web en temps réel et le RAG (retrieval-augmented generation).

Trois usages devenus table stakes. Voici des exemples concrets qui ne justifient plus d’innovation de base, mais d’intégration soignée :

Intégrez l’IA Générative (GenAI) dans votre activité

Nos formations IA Générative (GenAI) et prompt engineering sont conçues pour les équipes qui veulent apprendre à exploiter les IA comme un pro. Vous y apprenez à structurer des prompts efficaces, à exploiter les meilleurs outils (assistants IA type ChatGPT, générateurs d’images, audio et vidéo) et à les appliquer à vos vrais cas métiers : analyser vos données (GA4, BigQuery, CRM…), produire des contenus clairs et crédibles, prototyper plus vite et automatiser les tâches répétitives. Des ateliers 100 % pratiques, pensés pour les entreprises, pour gagner du temps, sécuriser vos usages et livrer des analyses et supports de décision de niveau pro.

- Ingestion documentaire pour support client : Automatisation de l’indexation et réponses contextualisées depuis la base docs.

- Plugins/connectors pour CRM : Synchronisation bidirectionnelle des tickets, suggestions d’actions et enrichissement client via le LLM.

- Recherche web en temps réel pour veille : Résumés et alertes dynamiques basés sur flux web et sources publiques.

Conséquences pour les équipes produit et infra. Les équipes passent moins de temps à « réinventer » l’indexation ou les connecteurs et plus de temps sur l’intégration, la sécurité, la gouvernance des prompts et l’orchestration (routing, fallback, latence, coûts).

Concentration du marché et risques. La standardisation augmente le pouvoir des grands fournisseurs (consolidation, acquisitions de startups spécialisées). Les risques incluent dépendance fournisseur, verrouillage propriétaire des connectors et uniformisation des comportements d’agent.

Transition. Face à cette commoditisation, l’intérêt se déplace vers l’orchestration, le contrôle fin des comportements, la robustesse des pipelines et l’évaluation continue — sujets du chapitre suivant.

| Brique commoditisée | Impact | Implication pour les équipes |

| Ingestion documentaire / RAG | Réponses contextuelles prêtes à l’emploi | Focus sur qualité des sources, coûts et gouvernance |

| Connectors / Plugins | Intégration native avec CRM, messagerie, DB | Gestion des permissions, résilience et compatibilité |

| Skills / Templates | Fonctions réutilisables standardisées | Orchestration, tests, personnalisation par domaine |

Quelles briques sont désormais natives

RAG, mémoire, connecteurs/apps, upload de documents et recherche web sont fréquemment intégrés aux offres LLM-as-a-service et considérés comme table stakes.

RAG (Retrieval-Augmented Generation) : Fonction : Utiliser un index de documents pour enrichir les réponses d’un modèle de langage par des passages pertinents.

- Valeur ajoutée : Améliore la précision factuelle et réduit l’hallucination du LLM.

- Limites : Coût et latence des requêtes d’indexation et de recherche, qualité dépendante du prétraitement des données.

- Exposition pratique : API de retrieval, projets intégrés, plugins d’indexation.

- Implications sécurité/gouvernance : Risque de fuite d’information via les passages récupérés, nécessité de contrôle d’accès et d’audit des documents indexés.

Mémoire : Fonction : Conserver des états, préférences ou historiques utilisateur entre sessions pour personnaliser les interactions.

- Valeur ajoutée : Expérience utilisateur cohérente et contextualisée.

- Limites : Vie privée, dérive du contexte, accumulation de données obsolètes.

- Exposition pratique : Endpoints mémoire, tables projets, SDKs stateful.

- Implications sécurité/gouvernance : Chiffrement, TTL (time-to-live) et opt-in utilisateur indispensables.

Connecteurs / Apps : Fonction : Accéder à sources externes (CRM, bases, APIs SaaS) pour actions et données en temps réel.

- Valeur ajoutée : Automation et actuallité des réponses.

- Limites : Surface d’attaque élargie, permissions complexes.

- Exposition pratique : Plugins, OAuth connectors, projects intégrés.

- Implications sécurité/gouvernance : Gestion fine des scopes OAuth, journaux d’activité et cloisonnement des secrets.

Recherche Web : Fonction : Interroger le web en direct pour données à jour.

- Valeur ajoutée : Actualité et vérifiabilité.

- Limites : Bruit, contenus non fiables, latence réseau.

- Exposition pratique : Endpoints search, plugins navigateur.

- Implications sécurité/gouvernance : Filtrage des sources, provenance et cache pour audit.

Skills / Templates : Fonction : Composants réutilisables ou workflows préconstruits pour tâches spécifiques.

- Valeur ajoutée : Vitesse de développement et standardisation.

- Limites : Rigidité si mal conçus, risques de logique embarquée non auditable.

- Exposition pratique : Bibliothèques, projets, marketplace de skills.

- Implications sécurité/gouvernance : Revue de code et sandboxing obligatoires.

# Pseudocode minimal : RAG retrieval puis appel connector

query = "Quel est le dernier rapport de ventes ?"

passages = RAG.search(query) # Recherche dans l'index

prompt = combine(query, passages[0:3]) # Concatène top-K passages

answer = LLM.generate(prompt) # Génération augmentée

if needs_action(answer):

connector_response = Connector.call(action="update_crm", payload=answer)

return connector_response

else:

return answer

Pièges opérationnels à éviter : fuite de contexte entre utilisateurs, latence élevée entraînant mauvais UX, coûts imprévus des requêtes RAG et des appels externes.

Trois bonnes pratiques :

- Appliquer un contrôle d’accès granulaire et audit des requêtes pour limiter les fuites.

- Mettre en place du caching et du TTL pour réduire latence et coût.

- Instrumenter la traçabilité des sources utilisées par le LLM pour la gouvernance.

| Brique | Niveau | Risques clés | Actions recommandées |

| RAG | Élevé | Fuite de passages sensibles, coût/latence | ACL sur index, monitoring coût, contrôle qualité des sources |

| Mémoire | Moyen | Vie privée, dérive contextuelle | Chiffrement, TTL, consentement explicite |

| Connecteurs | Élevé | Compromission d’API, permissions excessives | Scopes minimaux, rotation des clés, sandboxing |

| Recherche Web | Élevé | Sources non fiables, latence | Whitelist de sources, cache, attribution |

| Skills/Templates | Moyen | Logique non auditée, réutilisation dangereuse | Revue de code, tests unitaires, documentation |

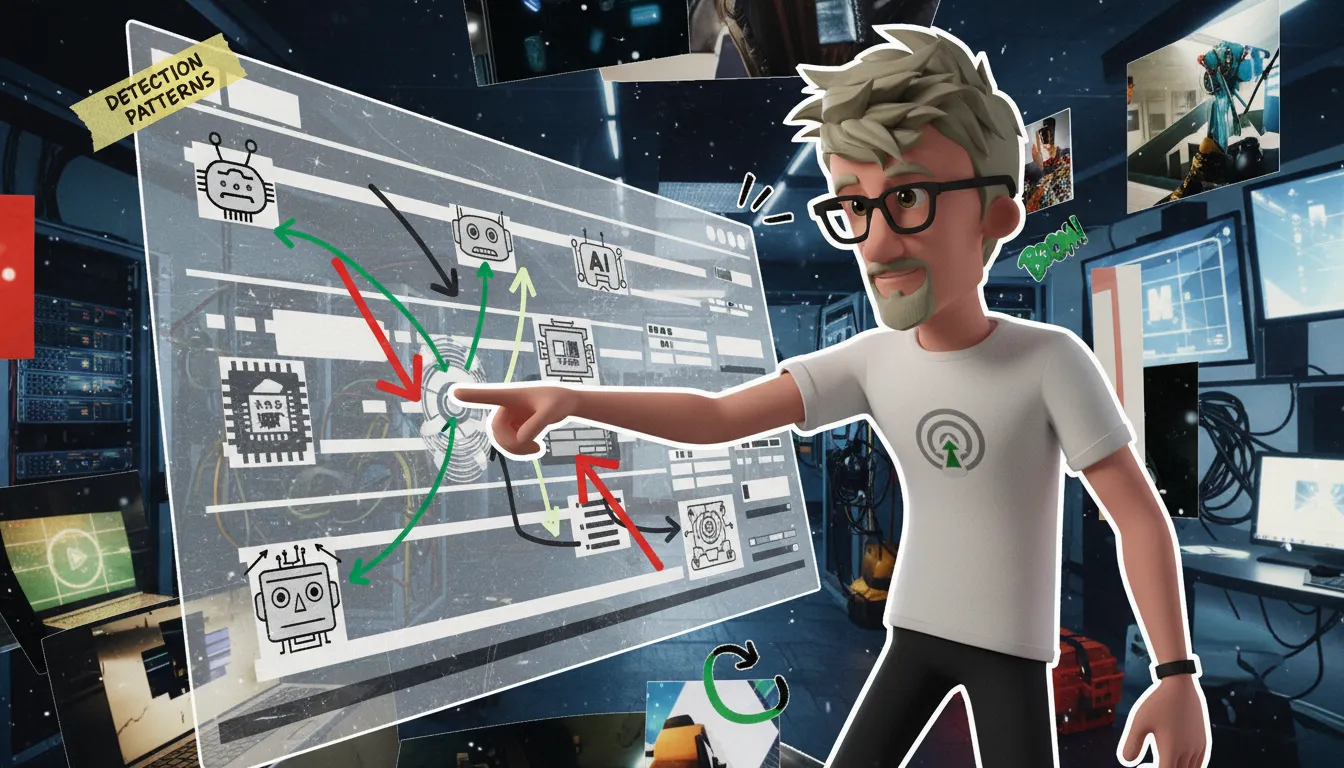

Qu’est-ce qui reste différenciant

Réponse courte : l’orchestration (routing, parallélisation, orchestrateur-workers), la modularité des agents (séquentiels et multi-agents), la codabilité et les composants déterministes demeurent les principaux facteurs de différenciation.

L’Orchestration pour agents désigne le système qui décide où, quand et comment une tâche est exécutée. Elle couvre le routing (attribution à un worker spécialisé), la parallélisation (exécution concurrente de sous-tâches) et le modèle orchestrateur-workers (contrôle central, exécution déléguée). À l’échelle, l’orchestration réduit les coûts, évite les goulets d’étranglement et permet d’appliquer des politiques (quota, sécurité, latence) de façon centralisée.

Agents séquentiels vs multi-agents collaboratifs : Les agents séquentiels forment une chaîne d’étapes prévisibles (extraction → validation → synthèse). Les multi-agents collaboratifs regroupent spécialistes qui communiquent et se répartissent le travail (extraction par A, vérification par B, synthèse par C). Exemple d’usage : pipeline de validation pour automatisation où un agent extrait les données, un agent vérifie la conformité et un agent rédige le rapport final.

Codabilité : Il s’agit de rendre les workflows d’agents exprimables en code, testables et intégrables en CI/CD. Tests unitaires pour chaque composant, tests d’intégration pour le flux complet, métriques de maintenabilité (couverture de tests, complexité cyclomatique, MTTR — Mean Time To Recover). Mesurer la maintenabilité passe par la diminution des tests flakys et par l’augmentation régulière de la couverture des cas critiques.

Composants déterministes : Ce sont des contrôles totalement prévisibles (checks systémiques, appels d’APIs de vérification comme VirusTotal pour URL, règles business codées). Ils fournissent des garanties auditables et limitent la dérive des modèles génératifs.

# Orchestrateur simple : route vers un worker LLM, puis vérifie l'URL via VirusTotal-like API

def orchestrator(task):

# Récupère le worker spécialisé LLM

worker = select_worker('llm-specialized')

# Exécute la génération

result = worker.generate(task['prompt'])

# Vérification déterministe : contrôle d'URL

url = extract_url(result)

is_safe = verify_url_with_api(url) # appel API tiers déterministe

return {'result': result, 'url_safe': is_safe}

- Latence — Mesure : p95/p99 de réponse.

- Routage — Mesure : taux de bonnes attributions.

- Observabilité — Mesure : couverture des traces et logs.

- Isolation — Mesure : blast radius en cas de défaillance.

- Reprise sur erreur — Mesure : MTTR et taux de succès après retry.

| Orchestration | Challenge: Scalabilité et routage précis | Action recommandée: Implémenter routing dynamique et worker pools |

| Codabilité | Indicateur clé: Couverture tests & MTTR | Action recommandée: CI/CD pour workflows, tests end-to-end |

| Déterminisme | Challenge: Garantir décisions auditables | Action recommandée: Isoler checks deterministes et APIs de vérification |

Comment évaluer les plateformes d’agents aujourd’hui

Réponse courte : évaluer une plateforme en 2026 exige de mesurer l’orchestration, le contrôle déterministe, l’intégration sécurisée des connecteurs et la qualité des outils d’évaluation (tests, métriques, audits).

Évaluation pragmatique et actionnable pour décider vite et bien.

- Commoditisation: Vérifier si le noyau agent est standardisé ou propriétaire, et si des protocoles ouverts (ex. JSON-RPC, AsyncAPI) sont supportés.

- Orchestration: Mesurer la capacité à séquencer tâches, gérer états et rollback, et à paralléliser sans conflit.

- Contrôle déterministe: Tester la répétabilité des runs avec seeds et versions de modèles.

- Connecteurs sécurisés: Contrôler chiffrement, scopes OAuth, et tunneling pour systèmes internes.

- Observabilité: S’assurer de logs structurés, traces distribuées et métriques temps réel.

- Tests intégrés: Recherche d’un framework de tests unitaires, e2e, et fuzzing de prompts.

- Métrologie des décisions: Capacité à exporter décisions, probabilités et raisons (explainability).

- Coût & scalabilité: Mesurer coût par exécution, burst capacity et modèle de facturation.

- Vendor lock-in: Evaluer export de flows, playbooks et formats de prompts.

- Conformité & audit: Vérifier trails immuables, RBAC et rapport d’audit automatisé.

- Tests unitaires d’agents: Mocker connectors, valider transitions d’état et règles métier.

- Tests end-to-end: Simuler scénarios clients, mesurer latence, succès métier et régressions.

- Fuzzing de prompts: Injecter variations adversariales pour détecter hallucinations.

- Métrologie des décisions: Collecter score/confidence, temps de décision et fréquence de fallback.

- Intégration d’audits: Utiliser frameworks comme OpenAI Evals, LangChain evals ou Promptsource pour batch-eval; répéter et versionner chaque jeu de test.

- KPIs business: TTR (Time To Resolution), taux d’automatisation, erreurs critiques évitées, coût par transaction automatisée.

- Méthode calcul rapide: Coût par transaction = (Coût infra + licences)/Nombre transactions automatisées sur période.

Cas d’usage : automatisation support client.

- Étapes de test: 1) Création scénarios 100 tickets représentatifs. 2) Exécution e2e. 3) Injection d’erreurs et handover humain.

- Métriques à collecter: TTR moyen, taux de résolution autonome, taux d’escalade, précision des réponses (F1), coût par ticket.

- Seuils acceptables: Résolution autonome ≥ 70%, TTR ≤ 30% du TTR humain actuel, F1 ≥ 0.85 pour intents critiques.

| 5 questions clés au vendeur | 5 tests techniques à mener |

| Comment garantissez-vous la reproductibilité des runs ? | Exécuter 10 runs identiques et comparer outputs et traces. |

| Quels connecteurs sont certifiés pour données sensibles ? | Tester intégration avec sandbox SSO/OAuth et vérifier logs chiffrés. |

| Comment s’effectue l’export des playbooks et prompts ? | Exporter/importer un flow complexe et valider exécution locale. |

| Quels outils d’évaluation et d’audit fournissez-vous ? | Lancer suite OpenAI Evals ou LangChain evals sur jeux de test. |

| Quelle est la tarification au scale et les garanties SLA ? | Mesurer latence et coût réel sur 1 semaine de charge simulée. |

Prêt à reconsidérer vos outils d’agents IA ?

En 2026, la plupart des briques de base des agents IA sont devenues des commodités fournies par les LLM-as-a-service. Pour tirer un avantage réel, concentrez-vous sur l’orchestration, la codabilité, le déterminisme et une évaluation rigoureuse. Adoptez des contrôles déterministes pour les étapes sensibles, mesurez les bons KPIs et testez l’opérabilité à l’échelle. En agissant ainsi, vous réduisez les risques, optimisez les coûts et obtenez des automatisations fiables et évolutives pour votre business.

FAQ

RAG (retrieval-augmented generation), gestion de mémoire/context, connecteurs/plugins pour apps externes, upload et usage de documents comme contexte, et recherche web en temps réel constituent aujourd’hui les fonctions de base intégrées par de nombreux LLM-as-a-service.

Le déterminisme permet d’imposer des vérifications systématiques (ex. checks via APIs tierces, règles métier codées) pour éviter les erreurs coûteuses ou non reproductibles. Il est essentiel dans les workflows sensibles (sécurité, conformité, finance) où la logique probabiliste du LLM ne suffit pas.

Vérifiez : routage et parallélisation, observabilité (logs, traces), isolation des données, support de tests et CI, intégration de contrôles déterministes, latence/coûts, et risques de vendor lock-in.

Menez tests unitaires d’actions, tests end-to-end sur workflows, fuzzing de prompts, tests de reprise erreur, et audits de sécurité pour les connecteurs. Mesurez KPIs (taux d’automatisation, erreurs critiques, TTR) et répétez les évaluations de façon reproductible.

Oui. Les connecteurs peuvent exposer des données sensibles, introduire des surfaces d’attaque et compliquer la gouvernance. Imposer des revues sécurité, des quotas d’accès, et des contrôles déterministes avant exécution réduit ces risques.

A propos de l’auteur

Franck Scandolera — expert & formateur en Tracking avancé server-side, Analytics Engineering, Automatisation No/Low Code (n8n), intégration de l’IA en entreprise et SEO/GEO. Responsable de l’agence webAnalyste et de l’organisme de formation « Formations Analytics ». Références clients : Logis Hôtel, Yelloh Village, BazarChic, Fédération Française de Football, Texdecor. Dispo pour aider les entreprises => contactez moi.